2nd 함께하는 딥러닝 컨퍼런스(2nd DLCAT)

딥러닝을 시작하는 이유는 달라도 딥러닝을 계속 하는 이유 중 하나는 바로 ‘함께하는 즐거움’이지 않을까합니다. 작년 6월 말 대전에서 “1st 함께하는 딥러닝 컨퍼런스”에 400명 넘게 모여 즐겁게 인공지능 및 딥러닝 관한 다양한 주제로 톡을 나누었습니다. 그간 매일 논문만 읽어도 못 따라갈 만큼 새로운 연구가 쏟아지고 있고, 그 활용 사례 및 관심 또한 각 분야에 퍼져가고 있습니다. 대전은 전국 각지에서 오시기에 접근성이 용이하고, 정부출연연구원 및 정부청사, 우수한 대학교, 대기업의 기술 연구소, 최첨단 기술 중심의 벤처회사들이 밀집된 지역인 만큼 지식공유의 즐거움을 나누고자 합니다.

별도의 참가비는 없습니다. 연사분들도 여러분과 즐기게 위해 재능기부합니다. 주차공간이 협소하므로 대중교통을 이용해주세요.

신청은 아래 링크에서 해주세요~

» 신청하기 «

- 일시: 2019년 7월 4일 (10시~18시)

- 장소: 대전광역시 유성구 가정로 217

- 과학기술연합대학원대학교 - 대전광역시 유성구 가정로 217

- ETRI 융합기술연구생산센터 - 대전광역시 유성구 가정로 218

- 주최: (주)인스페이스 - (주)인스페이스는 한국항공우주연구원 출신 연구원들이 시작한 벤처회사로 위성지상국 개발 및 활용 전문 기술을 기반으로 사업 영역을 확장하고 있습니다. 현재 “태양에서 세포까지 딥러닝”, “게임에서 우주까지 강화학습”의 모토로 여러분야 인공지능을 적용하고자 활발히 연구 개발 중입니다. 인공지능은 기술을 넘어 산업체, 학계, 정부출연연과 오픈 커뮤니티의 공동상생할 수 있는 생태계를 만들고 있기 때문에 인스페이스는 대전을 중심으로 인공지능 생태계를 위한 소통의 장을 형성하기 위해 노력하고 있으며 확대할 계획입니다.

- 주관: 대딥사, 케라스 코리아, 캐글 코리아, RL 코리아, NIPA(정보통신산업진흥원)

- 후원

- UST 과학기술연합대학원대학교

- ETRI 융합기술연구생산센터

- 대전정보문화산업진흥원

- (주)유클리드소프트 - 유클리드소프트는 정부부처 및 공공기관 서비스 개발과정에서 축적한 솔루션 기반 탄탄한 기술력 위에 빅데이터 분석, AI기반 CCTV 행동 패턴 분석, CNN, RNN, GAN 등 최신 기술을 접목하여, 고객의 핵심 가치에 더 나은 핵 가치를 제공하고자 계속 노력하고 있는 덕후 개발자들의 회사입니다.

- 도서증정

- 길벗

- 모두의 딥러닝 3권

- 케라스 창시자에게 배우는 딥러닝 3권

- 머신 러닝 교과서 with 파이썬, 사이킷런, 텐서플로우 3권

- 디지털북스

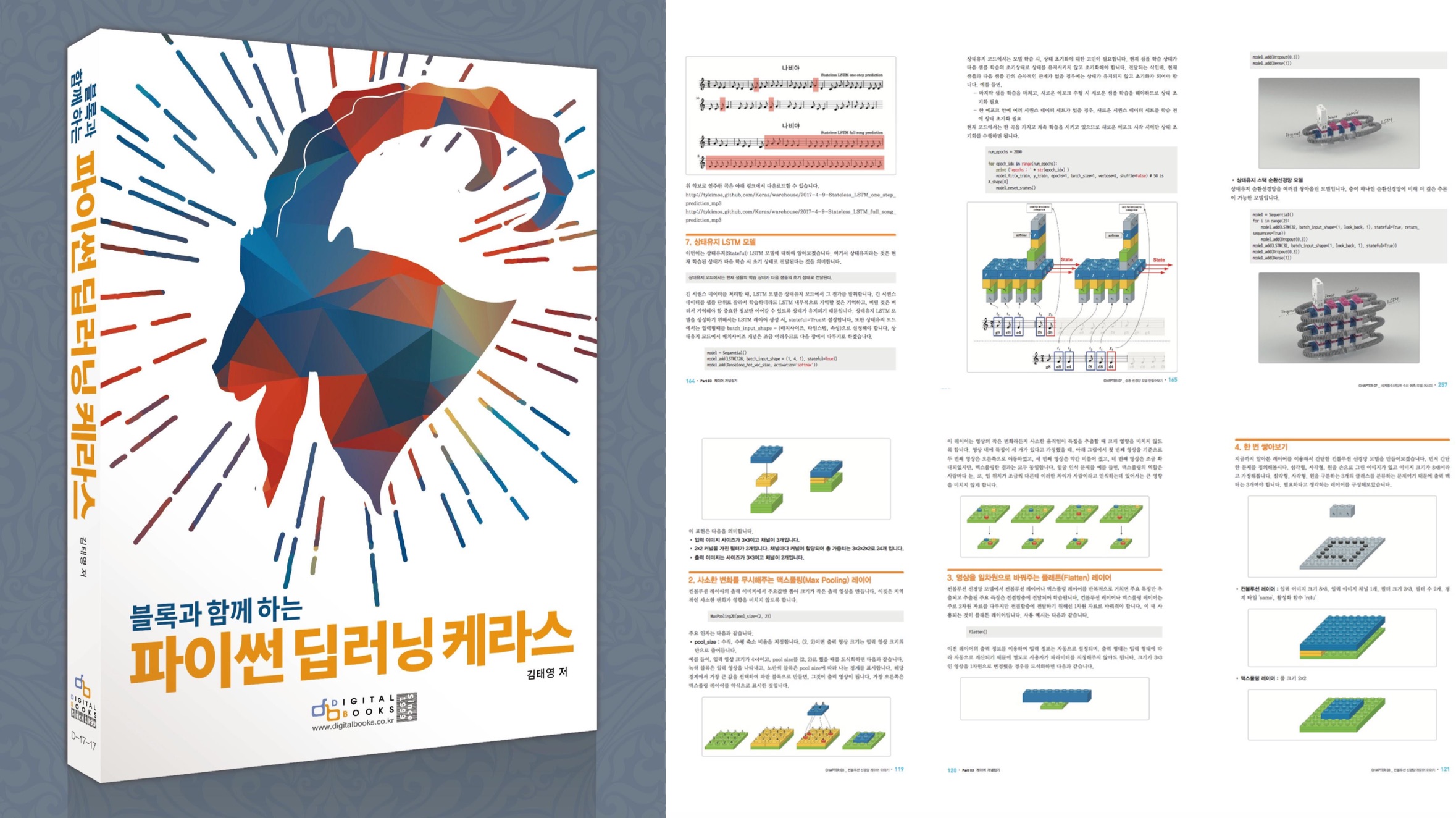

- 블록과 함께하는 딥러닝 파이쎤 케라스 5권

- 대소니 딥러닝 5권

- 길벗

- 대상: 인공지능 및 딥러닝에 관심있거나 관련 연구를 수행하시는 분들 (약 700명)

- 트랙 A: UST 강당 300명

- 트랙 B: UST 사이언스홀 65명

- 트랙 C: UST 대회의실 35명

- 트랙 D: ETRI 융합기술연구생산센터 212호 대회의실 180명

- 트랙 E: ETRI 융합기술연구생산센터 224호 중회의실 50명

- 트랙 F: ETRI 융합기술연구생산센터 219호 중회의실3 20명

프로그램

| 시간 | A-USTaudi | B-USTsci | C-USTmeet | D-ETRI212 | E-ETRI224 | F-ETRI219 |

|---|---|---|---|---|---|---|

| 10시 | 조수현 3분 강화학습 순한맛 SAC |

이수진 AI시대의 예술작품 - AI Atelier를 이용하여 |

박해선 케라스 in 텐서플로우2.0 |

유용균 딥러닝과 최적설계 |

이현호 (실습)유니티 기반 드론 강화학습 (1) |

정연준 아기다리고기다리던딥러닝 - 케라스로 띄어쓰기 정복하기 (1) |

| 11시 | 안수빈 The Newbie Guide to Blogging & Visualization |

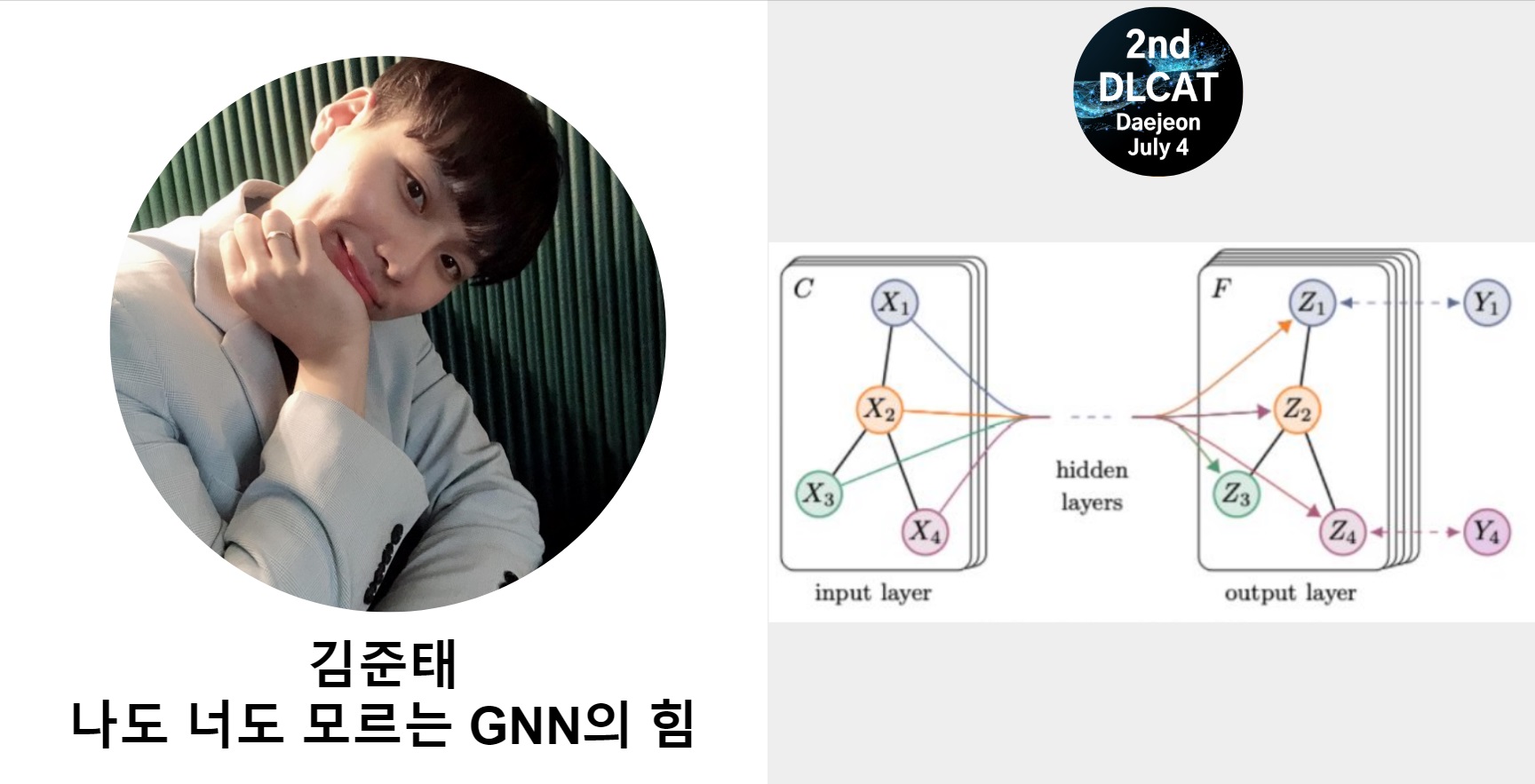

김준태 나도 너도 모르는 Graph Neural Network의 힘 |

안종훈 설명가능한 AI for AI 윤리 |

이유한 I’m Kaggler - Why need kaggle? |

이현호 (실습)유니티 기반 드론 강화학습 (2) |

정연준 아기다리고기다리던딥러닝 - 케라스로 띄어쓰기 정복하기 (2) |

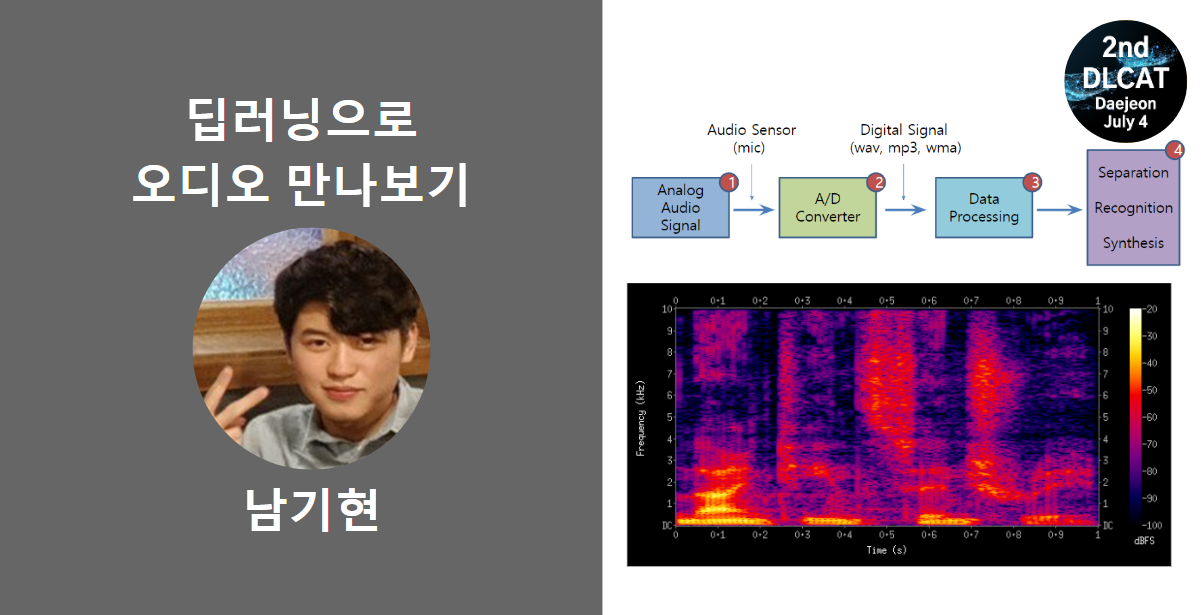

| 13시 | 남기현 (이론)딥러닝으로 오디오 만나보기 |

김유민 딥러닝 모델 엑기스 추출(Knowlege Distillation) |

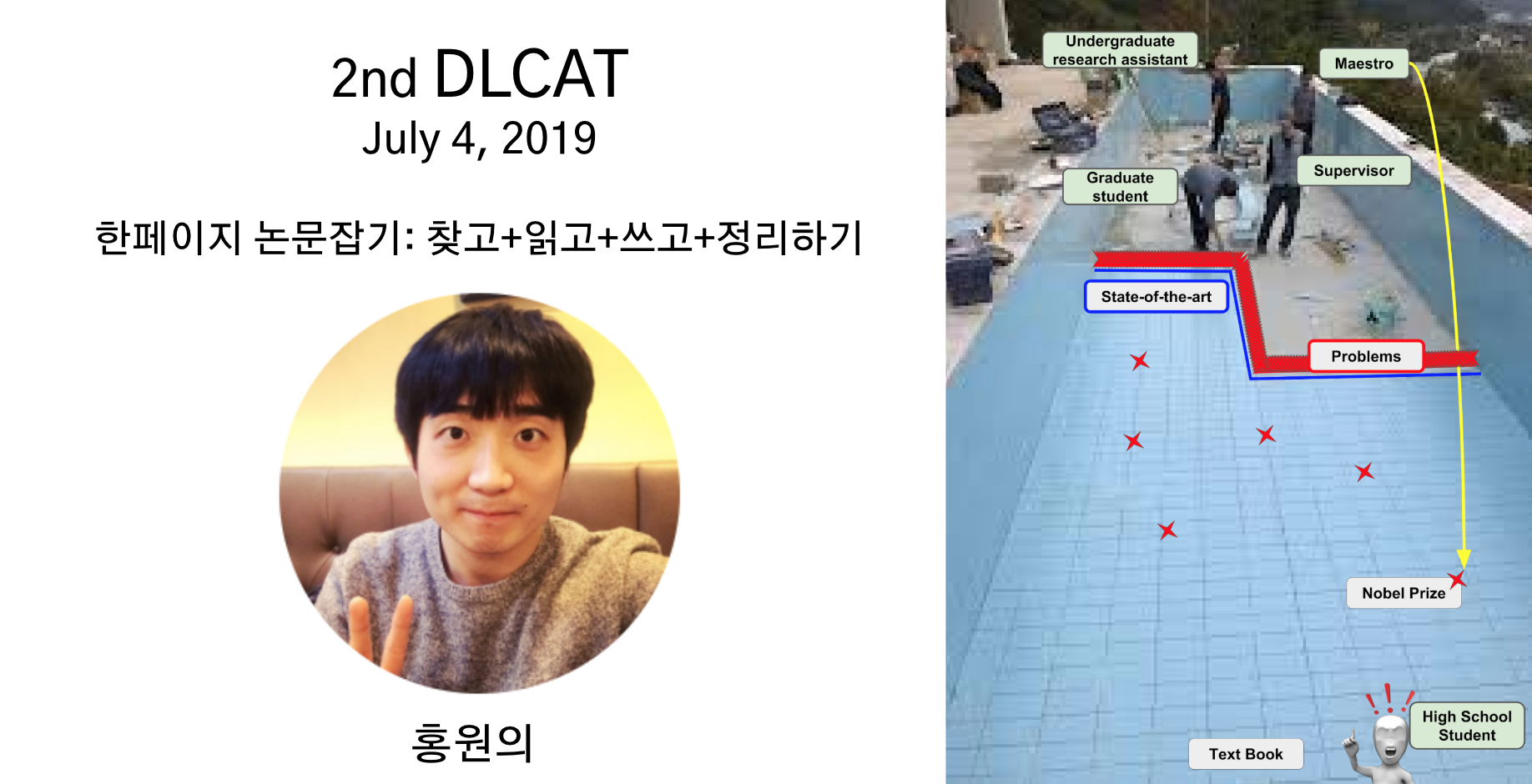

홍원의 (실습)한페이지 논문잡기:찾고+읽고+쓰고+정리하기 |

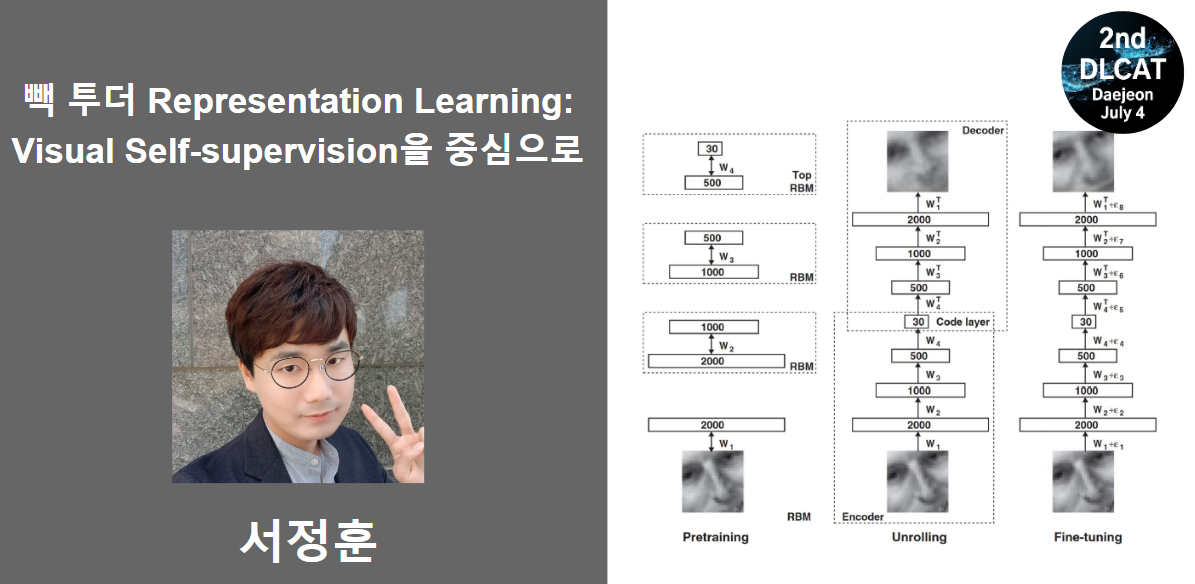

서정훈 빽 투 더 Representation Learning: Visual Self-supervision을 중심으로 |

신경인 (실습)파이토치로 갈아타기 (1) |

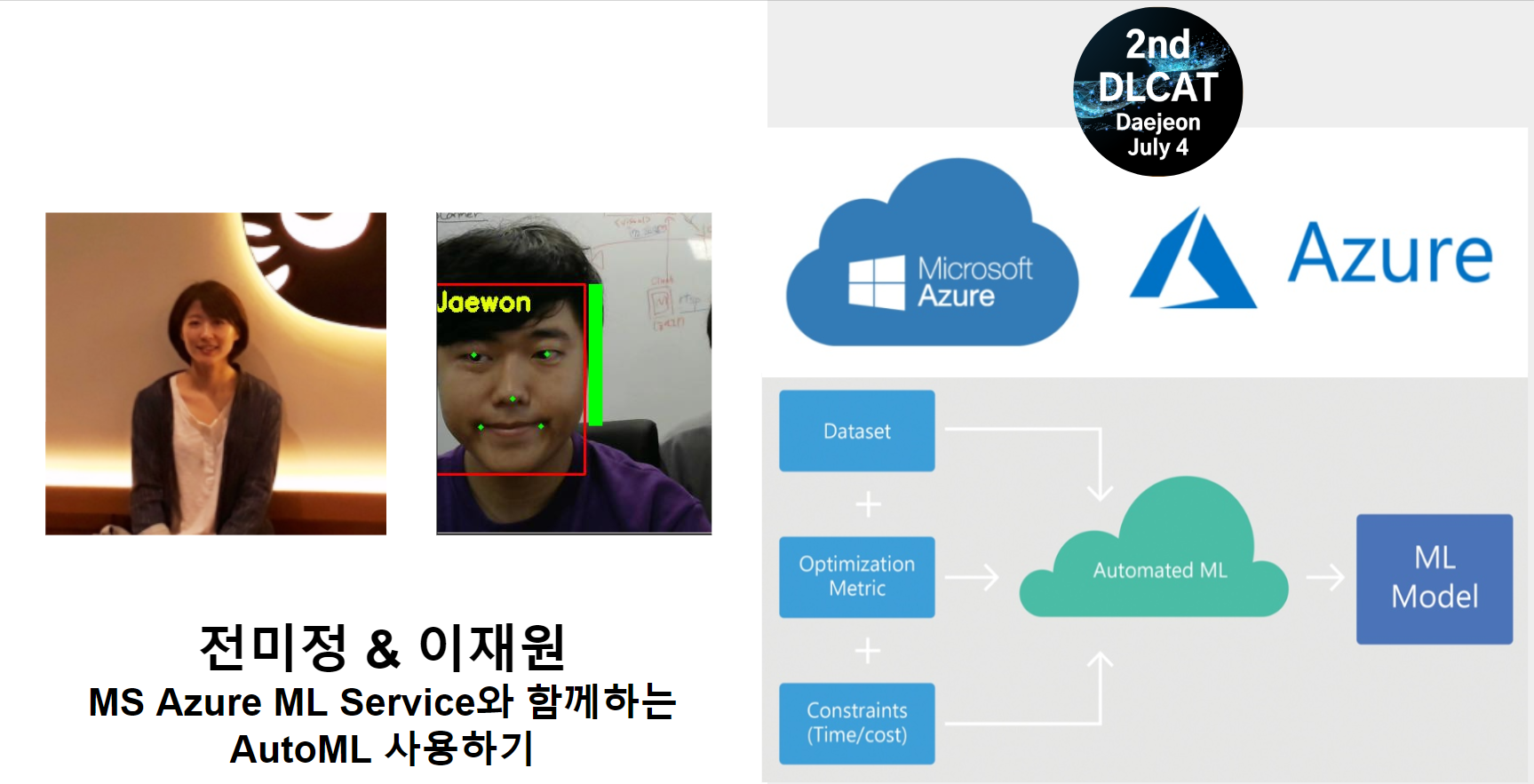

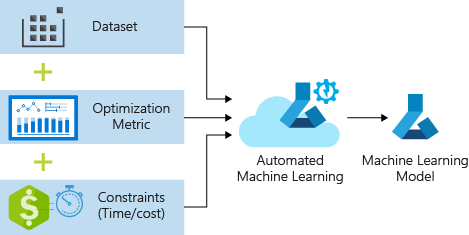

전미정 (실습)MS Azure ML Service와 함께하는 AutoML 사용하기(1) |

| 14시 | 황준원 (실습)딥러닝으로 오디오 만나보기 |

김영하 AutomatedML 동향 |

홍원의 (실습)한페이지 논문잡기:찾고+읽고+쓰고+정리하기 |

송규예 Deeplema, 딥러닝 서비스상용화의 딜레마 |

신경인 (실습)파이토치로 갈아타기 (2) |

전미정 (실습)MS Azure ML Service와 함께하는 AutoML 사용하기 (2) |

| 15시 | 민규식 강화학습 환경 제작, Unity ML-agents와 함께하세요 |

김태진 구글 코랩 TPU 알아보기 |

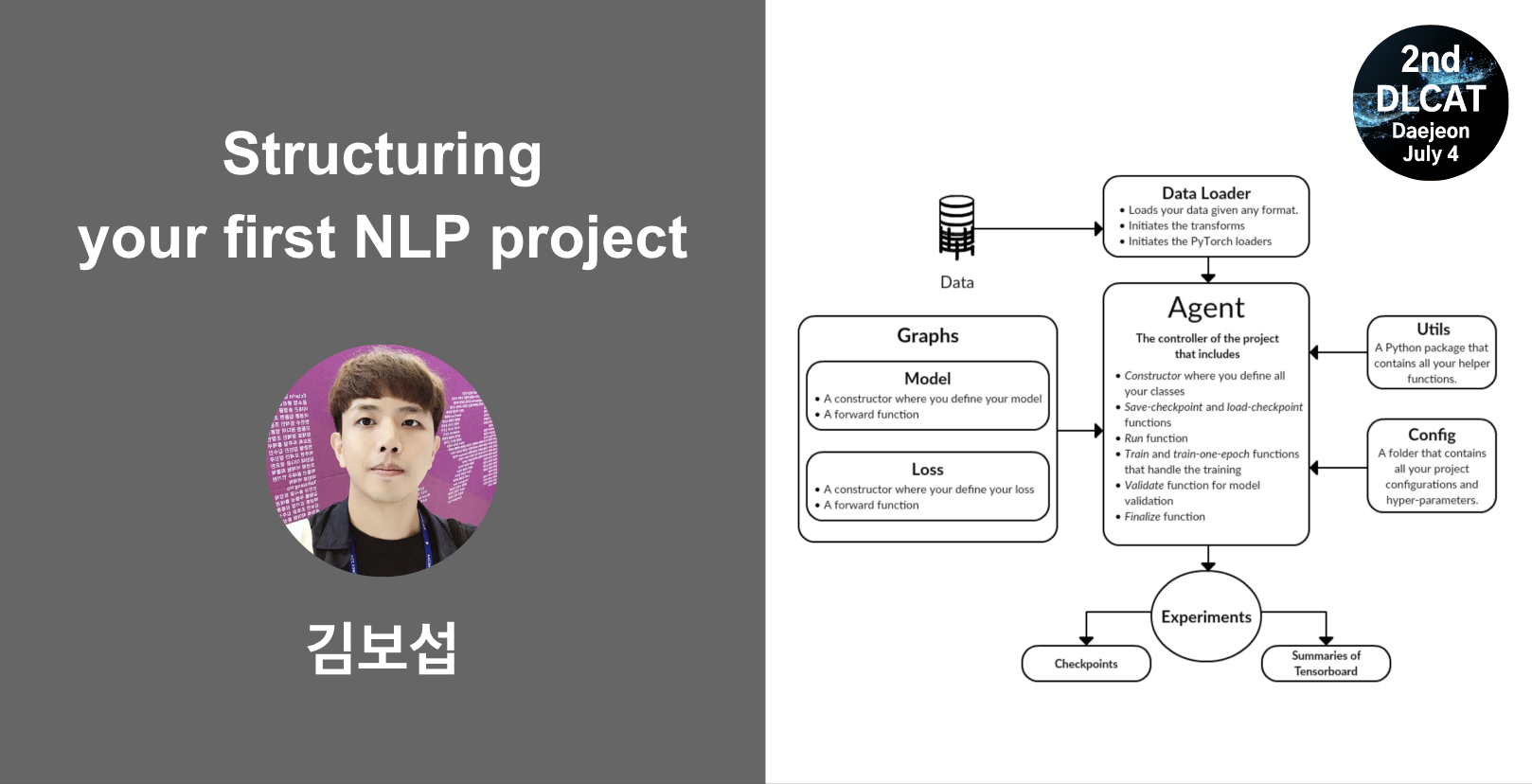

김보섭 Structuring your first NLP project (1) |

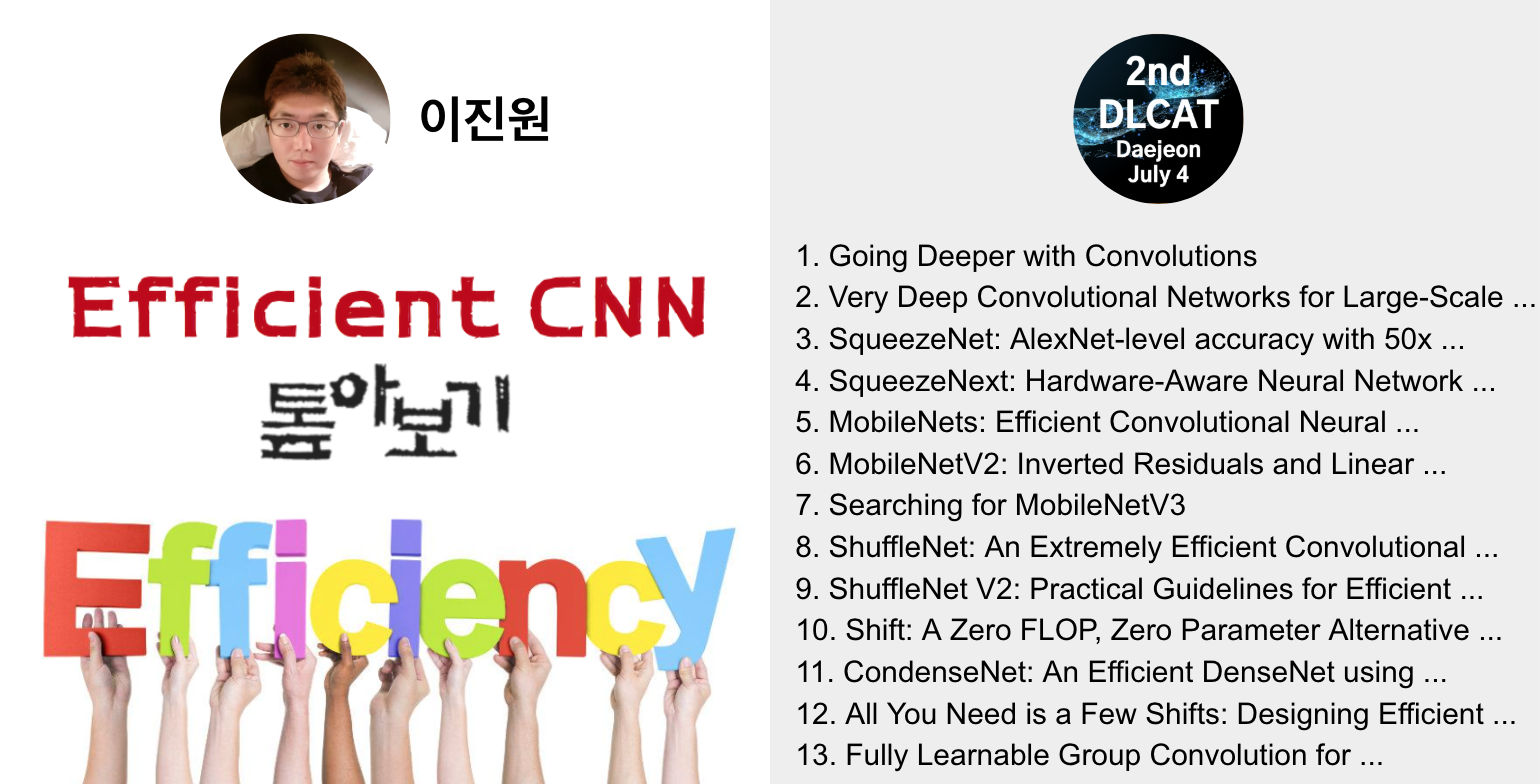

이진원 Efficient CNN 톺아보기 |

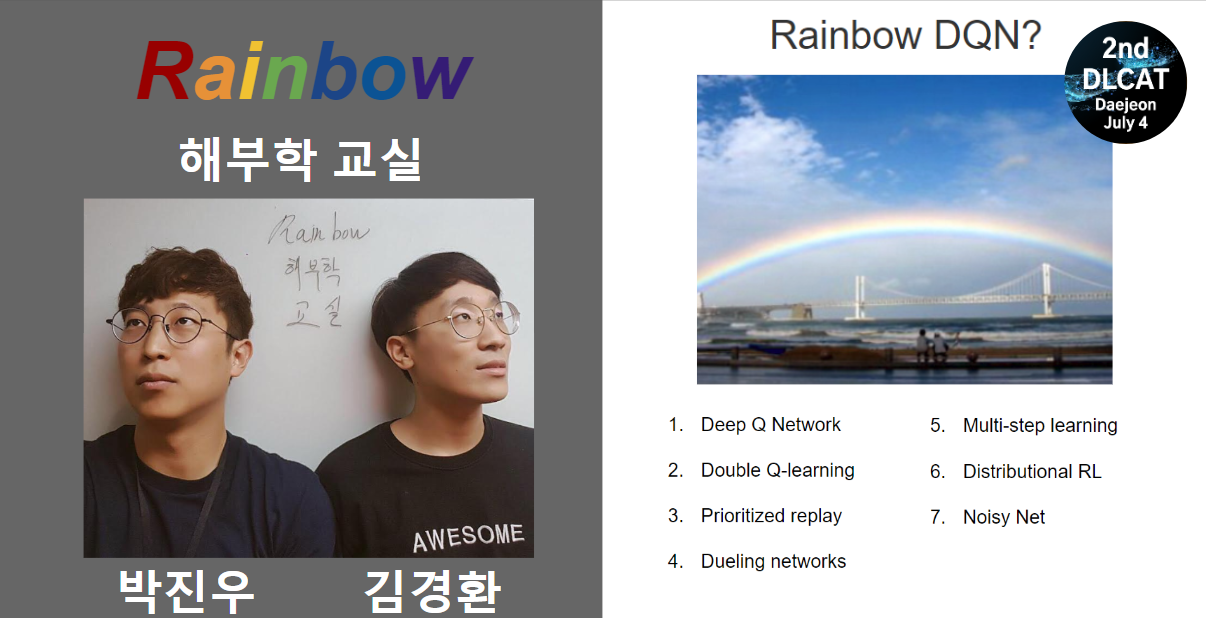

김경환,박진우 (실습)Rainbow로 달착륙부터 Atari까지 (1) |

대전AI거버넌스 AI 거버넌스 구성 |

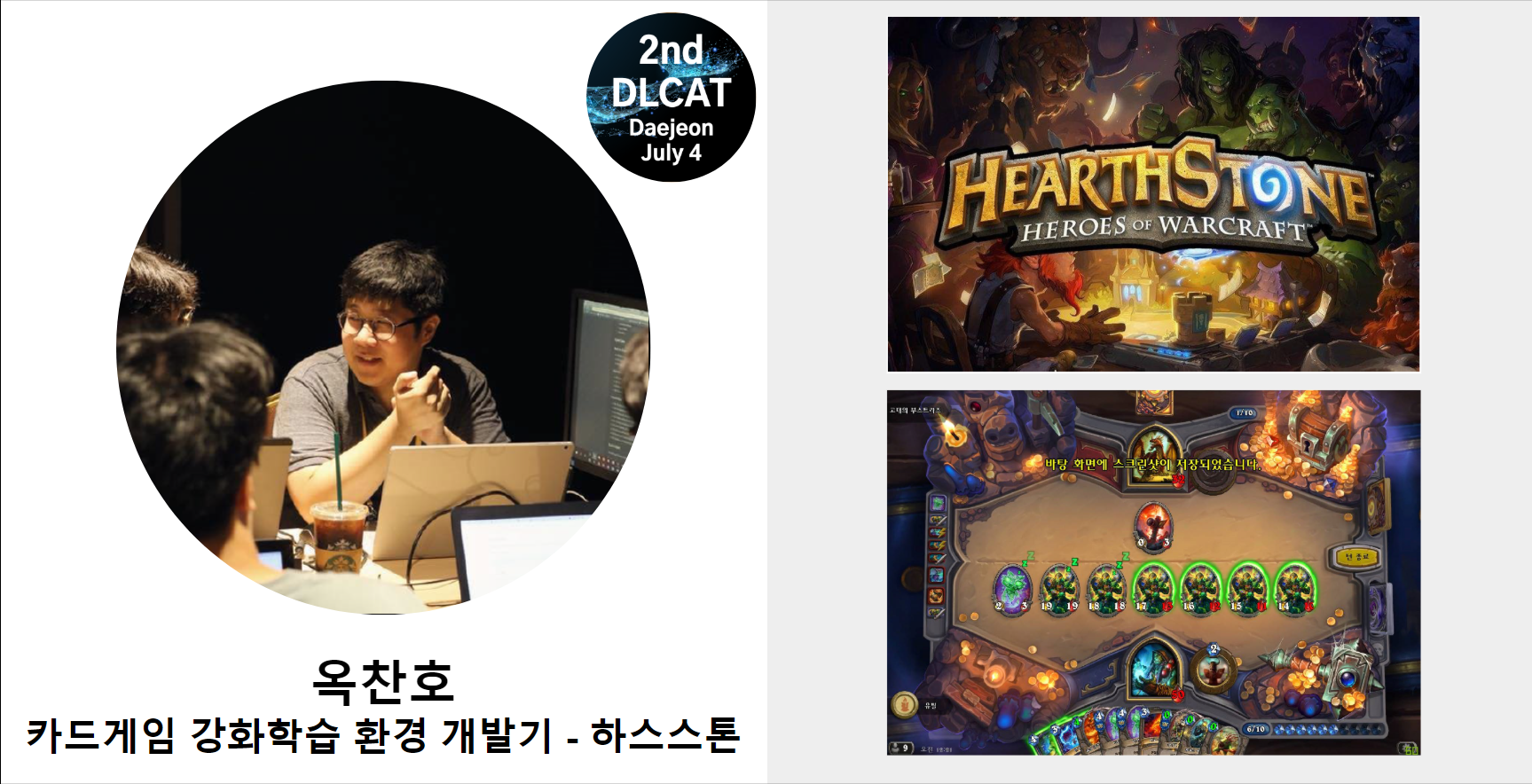

| 16시 | 옥찬호 카드게임 강화학습 환경 개발기 - 하스스톤 |

김형섭 GAN 동향 |

김보섭 Structuring your first NLP project (2) |

차금강 설명가능한 강화학습 |

김경환,박진우 (실습)Rainbow로 달착륙부터 Atari까지 (2) |

대전AI거버넌스 AI 적용 가속화 방안 |

| 17시 | 김태영 이제 |

김태영 하이퍼파라미터 |

김태영 튜닝은 |

김태영 케라스 튜너에게 |

김태영 맡기세요 |

대전AI거버넌스 한계 및 목표치 설정 |

- 점심시간은 12시 ~ 13시입니다.

- 각 세션은 45분 발표, 5분 질의응답, 10분 휴식 및 이동입니다.

- UST과 ETRI사이는 도보로 10분이내 거리에 있습니다. 따라서 쉬는 시간을 이용해서 이동하시면 됩니다.

신청은 아래 링크에서 해주세요~

» 신청하기 «

10시

조수현 - 3분 강화학습 순한맛 SAC(Soft Actor Critic) feat. AC(Actor Critic)

연사소개

현재 디아이티에서 딥러닝 엔지니어로 현실문제를 어떻게 해결 할 수 있나 즐겁게 준비하고 고민하고 일하고 있습니다. 이전 회사들에서는 B2B, B2C 애플리케이션 기반 서비스들의 백엔드개발을 다양한 아키텍쳐에서 주로 경험 하였습니다. 프론트엔드 개발도 주로 하였구요. 현재는 최고의 실력자들이 계신 디아이티에서 딥러닝 엔지니어로 현실문제를 어떻게 해결 할 수 있나 고민하고 많이 배우며 즐겁게 일하고 있습니다. 인공지능의 한 분야로서 딥러닝과 또 다른 맥락인 강화학습에 대해 초보 연구자로써 틈틈히 반 취미로 공부하고 배우고 있습니다. 또한 Real Lab 강화학습 스터디의 운영진으로 있습니다. 하고 싶은 건 많고 몸은 하나인 평범한 엔지니어입니다. 가치 추구 실현과 시간적 자유를 추구합니다.

- 깃헙: https://github.com/humblem2

- 이메일: seanbrowncho@gmail.com

발표소개

RL(Reinforcement Learning) 알고리즘은 최적화 문제에 쓰일 수 있고 앞으로 미래 먹거리가 될 수 있습니다. 특히나 로보틱스나 제어에서 많이 쓰이구요. 하지만 RL은 어렵습니다. 특히나 수식의 향연이 더욱 부추깁니다. 그래서 각 알고리즘의 아이디어에 대한 직관적인 이해가 특히 더 요구됩니다. 본 시간은 2018년 ICML 논문인 SAC(Soft Actor-Critic: Off-Policy Maximum Entropy Deep Reinforcement Learning with a Stochastic Actor) 알고리즘에 대해서 기본에 충실한 핵심 내용을 최대한 알기 쉽게 빠르게 공유 및 전달 하는 시간입니다. SAC알고리즘은 SAC알고리즘은 RL의 기본 가정인 tabular MDP를 Soft-MDP로 재정의(확장)하여 확률적으로 문제를 학습, 처리 하는 아이디어입니다. 이를 실현하기 위해 특별한(specific) 가정 추가 없이 기존 문제영역(high variance)을 해결하여 비교적 좋은 성능을 가진 알고리즘입니다. 금과옥조 (金科玉條)처럼 모든 task에 사용되는 알고리즘은 없습니다. 하지만 대개의 문제에 비교적 높은 성능과 학습 안정성을 나타내어 Google 내부적으로 직원들 사이에서 제일 인기가 있는 베이스라인 알고리즘이 바로 SAC 입니다. 함께 지식을 쌓아나갑시다. 실력자 분들 께서는 본 강연이 평이 할 수 있으니 컨퍼런스 당일 이 점 참고 하시어 즐기시면 됩니다.

발표자료

참고자료

*논문: Soft Actor-Critic: Off-Policy Maximum Entropy Deep Reinforcement Learning with a Stochastic Actor

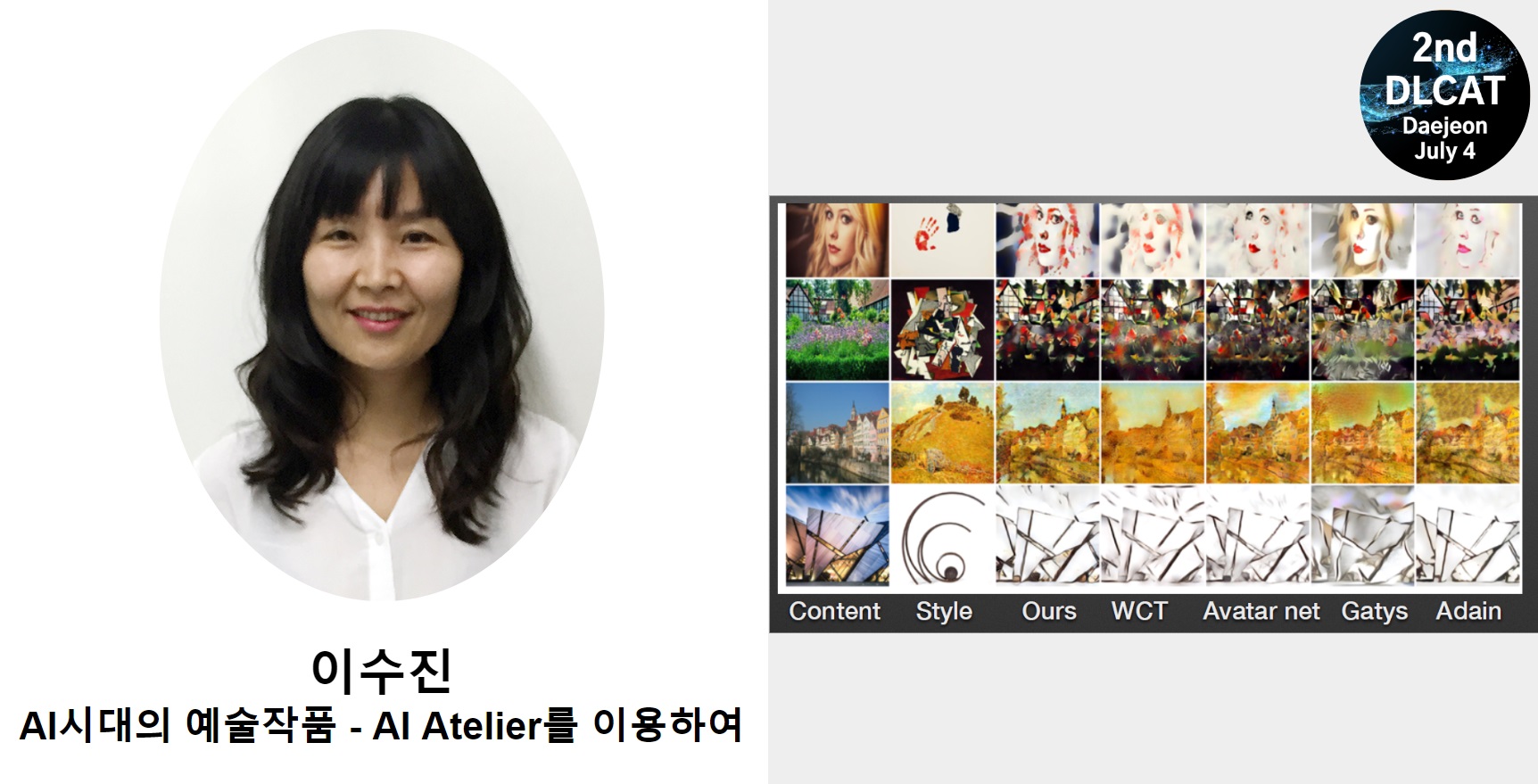

이수진 - AI시대의 예술작품 - AI Atelier를 이용하여

연사소개

미술과 거리가 있는 삶을 살아오다 광학현미경으로 들여다 본 이미지 세계에 탐닉하기 시작한 이후, 카메라 렌즈를 통해 세상을 보고 컴퓨팅 기술을 이용한 새로운 이미지 창출에 힘쓰고 있다. 비가시적인 세계를 가시의 세계로 끌어내는 연구를 거시 주제로 잡고 컴퓨터 비전과 머신 러닝 기술로 표현할 수 있는 알고리듬을 연구해 왔다. 실제 세계의 3차원 이미지 데이터를 2차원 평면에 비정형성으로 표현하는 것을 연구하고 최근에는 딥러닝 기술을 이용한 인공지능 도구(A.I. Atelier)로 사진과 그림을 재료로 하는 시각작품을 생산하고 있다. 인공지능연구원(AIRI) 협력 작가이며 생계와 삶의 활력을 불어 넣기 위해 대학교에서 학생들을 가르치고 있고 한국연구재단 후원을 받아 연구에 몰두하고 있다.

발표소개

인공지능연구원에서 개발한 A.I. Atelier는 인공지능(AI) 기술로 탄생한 새로운 시각예술 도구이다. 예술가의 창의성은 표현이라는 행위를 통해 비로 소 의미를 획득한다. 따라서 표현 도구를 다루지 못한다면 그 의미는 온전히 구현할 수 없다. A.I. Atelier는 끊임없이 의미의 실현을 모색하는 예술가적 창의성에 새로운 가능성을 제공한다. 발터 벤야민은 「기술 복제 시대의 예술작품」이라는 소논문에서 사진이나 영화와 같이 복제 가능한 기술로 탄생한 작품들도 고유의 예술성을 획득한다고 주장했다. 기존 표현 수단의 물리적 한계를 뛰어넘어 독창적인 이미지를 포착 하고 기록할 수 있기 때문이다. 그가 죽은 지 78년이 지난 지금, 그 때의 기술과는 차원이 다른 인공지능 시대가 도래 했다. 인공지능 기술은 지금까지 인류가 창조한 이미지를 재료로 삼아 누구도 체험하지 못한 예술의 영역을 개척하고 있다. 그 결과의 하나가 A.I. Atelier이다. 지금까지 인공지능 기술로 탄생한 화풍 변환 기술(Style Transfer)은 하나 의 이미지에 고흐나 피카소 등 특정한 화가의 화풍 하나를 선택해 입혀주는 수준이었다. A.I. Atelier는 한 발 더 나가 새로운 방식으로 작품을 생산할 수 있는 가능성을 제공한다. 이미지를 픽셀 단위로 쪼개 다양한 화풍을 동시에 적용 할 수 있다. 원 이미지에 없는 오브젝트를 새로 만드는 데도 한계가 없다. 인터넷이라는 바다에 잠자고 있는 무수히 많 은 예비 오브젝트를 실시간으로 찾아 추가하면 된다. 이런 과정으로 창작할 수 있는 이미지의 범위는 사실상 무제한에 가깝다. 결국, 필요한 건 상상력뿐이다.마음만 먹으면 누구나 예술가가 될 수 있는 길에 대해 이야기 해 본다.

발표자료

참고자료

TBD

박해선 - 케라스 in 텐서플로우2.0

연사소개

ML GDE(Machine Learning Google Developer Expert)입니다. 기계공학을 전공했지만 졸업 후엔 코드를 읽고 쓰는 일을 했습니다. 텐서플로 문서 번역에 기여하면서 소프트웨어와 과학의 경계를 흥미롭게 탐험하고 있습니다. “머신 러닝 교과서 with 파이썬, 사이킷런, 텐서플로”, “케라스 창시자에게 배우는 딥러닝”(이상 길벗), “(개정판)파이썬 라이브러리를 활용한 머신러닝”, “핸즈온 머신러닝”, “텐서플로 첫걸음”(이상 한빛미디어)을 번역했습니다.

- 블로그: https://tensorflow.blog

- 깃헙: https://github.com/rickiepark

- 이메일: haesunrpark@gmail.com

발표소개

텐서플로 2.0에서 변화된 내용을 소개하고 텐서플로 2.0에서 케라스가 어떤 역할을 담당하게 되었는지 소개합니다. 기본적인 케라스 사용법외에 텐서플로에서 케라스를 이용한 사용자 정의 모델을 어떻게 구현하는지도 알아보겠습니다.

발표자료

참고자료

- https://www.tensorflow.org/

유용균 - 딥러닝과 최적설계

연사소개

원자력연구원에서 인공지능 덕질을 해오다가 최근 덕업일치를 이루려고 연구원내 새로운 조직을 준비중입니다. 최적설계 분야와 원자력의 다양한 안전관련 기술에 인공지능 기술을 접목하기 위해 노력하고 있습니다.

발표소개

인공지능 기술을 활용한 최적설계 분야의 응용사례에 대해서 소개합니다.

발표자료

TBD

참고자료

TBD

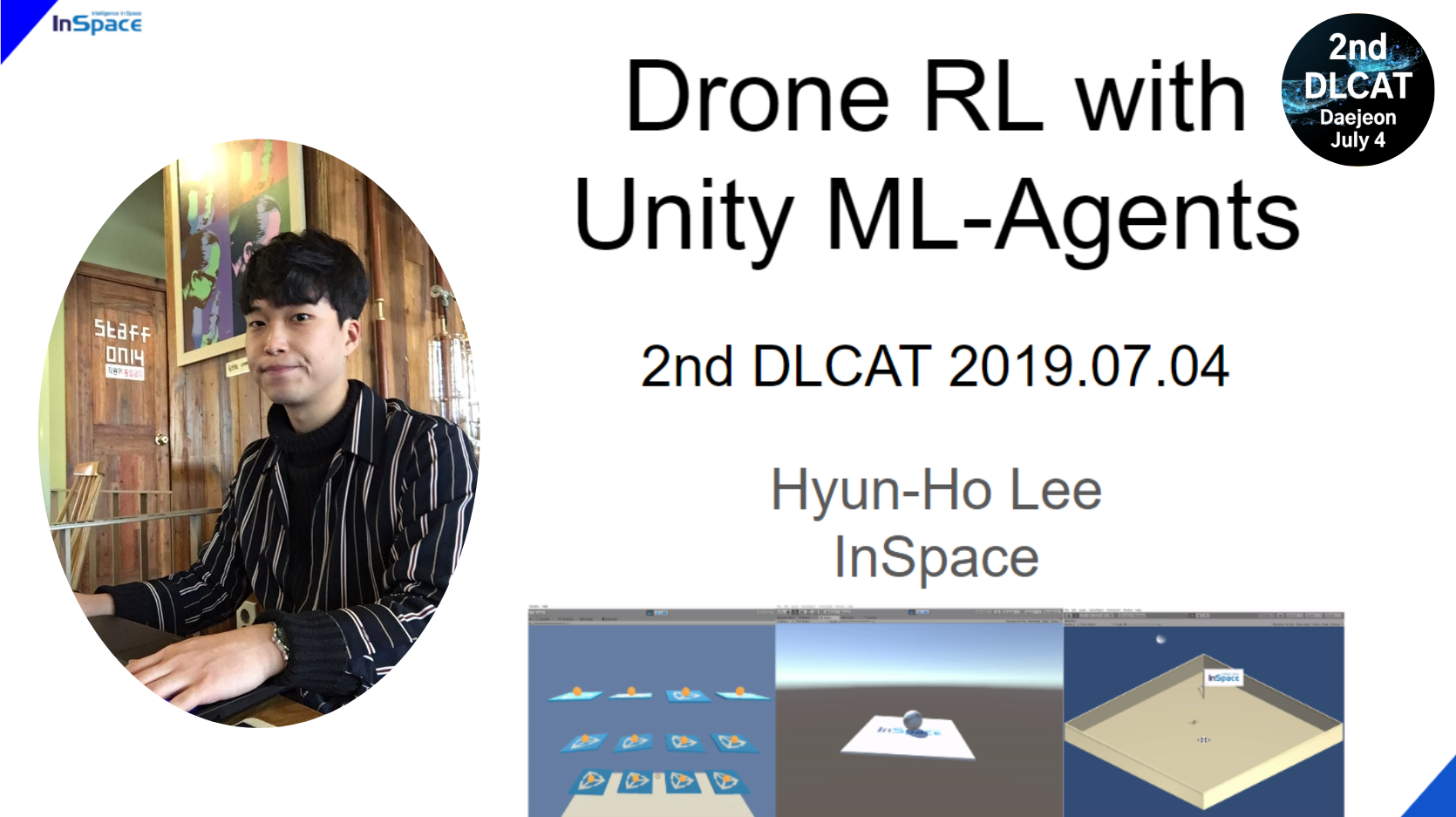

이현호 - (실습)유니티 기반 드론 강화학습

연사소개

응용수학과 컴퓨터공학을 복수전공하고 이를 활용하기 위해 인공지능 공부를 시작하였습니다. 현재 (주)인스페이스 인공지능 연구실에서 AI 연구원으로서 실생활 문제들을 인공지능을 통해 해결하고자 노력하고 있습니다. 특히 강화학습 시뮬레이션 환경 제작에 흥미가 있어 Unity ML-Agents 를 통해 발사체, 로켓, 드론, 당구 등 여러 강화학습 환경 제작을 진행하고 있습니다.

- 이메일: hyunho1027@khu.ac.kr

- 깃헙: https://github.com/hyunho1027

- 유튜브: https://www.youtube.com/channel/UCZx739AbunG2bGD5t0sNAhw

발표소개

항공우주분야에 강화학습을 적용하기 위해 만든 시뮬레이션 환경들을 소개하고자 합니다. 특히 드론 환경에 대해서 자세히 살펴보고 실습을 통해 직접 드론을 제작해보는 시간도 가져보겠습니다. 추가적으로 딥러닝, 강화학습 그리고 Unity ML-Agetns에 대해 간략하게 살펴보도록하겠습니다. 원활한 실습을 위해 참고자료의 Unity ML-Agents Tutorial을 한 번 진행해보시는것을 권장드립니다.

발표자료

참고자료

- Unity ML-Agents Tutorial github : https://github.com/hyunho1027/Unity_ML_Agents_Tutorial

- Unity based Drone environments github : https://github.com/InSpaceAI/RL-InDrone

- Unity based RL environments youtube : https://www.youtube.com/channel/UCZx739AbunG2bGD5t0sNAhw

정연준 - (실습)아기다리고기다리던딥러닝 - 케라스로 띄어쓰기 정복하기

연사소개

케라스 코리아 운영진 및 셀바스AI 컴퓨터 비전 연구원. 취미로 오픈소스를 하는 사람입니다.

- CV: https://fuzzythecat.github.io

- 깃헙: https://github.com/fuzzythecat

- 이메일: fuzzy0427@gmail.com

발표소개

많은 사람들이 어려움을 겪고있는 “띄어쓰기”를 딥러닝으로 해결해보고자 하는 과정을 소개합니다. 이를 위해 필요한 이론과 기본적인 케라스 사용법을 다루며, 최종적으로 각자의 모델을 테스트 해보는 시간을 가질 예정입니다.

발표자료

참고자료

TBD

11시

안수빈 - The Newbie Guide to Blogging & Visualization

연사소개

“모두를 위한 인공지능”을 꿈꾸는 인공지능 꿈나무 안수빈입니다. 현재 페이스북 페이지 A.I.Lookbook(구 어썸너드 수비니움)을 운영하고 있으며, 캐글 코리아에서 한글화프로젝트 및 블로그를 담당하고 있습니다. 코딩보다는 글쓰기를 좋아합니다.

- 블로그: https://subinium.github.io

- 페이스북 페이지: https://facebook.com/AI.Lookbook

- 깃헙: https://github.com/subinium

- 이메일: me@ansubin.com

발표소개

지난 6개월간 인공지능으로 블로그와 페이지를 운영하며, 느낀점을 여러분과 공유하고자 합니다. 추가적으로 최근 블로그의 메인 주제인 (딥러닝 및 데이터사이언스에서) 시각화를 이야기해보고자 합니다.

- 글을 쓰는 이유와 장점

- 블로그, 어떻게 꾸준하게 할 수 있을까

- Visualization 가이드

발표자료

참고자료

TBD

김준태 - 나도 너도 모르는 Graph Neural Network의 힘

연사소개

안녕하세요 현재 고려대학교에서 석사과정 중이고 작년에 1st DLCAT에서 “GTA5로 자율주행 자동차 만들기” 발표를 진행한 김준태라고 합니다. 관심분야로는 주로 Time Series, 강화학습, 딥러닝이고, 새로운 Research Area로 GNN을 이용한 VQA에서의 relation 연구를 시작했습니다.

- CV: https://sites.google.com/s/1o2nR2sFY7c4VUrosW1Fivbt_4mhKiQAX/p/1h52r1XhKqPvElCInPU717DjCwFNsrr7r/edit

- 깃헙: https://github.com/OPAYA

- 이메일: kjt7889@naver.com

발표소개

“나도 너도 모르는 GNN의 힘” 발표는 Graph Neural Network 공부를 시작한 지 1주일 된 초보자가 초보자에게 Graph Neural Network의 기본적인 개념을 알려주는 발표이니 부담감 없이 들으시면 됩니다. 발표는 2019 ICLR에서 발표한 “How Powerful are Graph Neural Networks?”를 기반으로 진행됩니다.

발표자료

참고자료

- 논문

- K.Xu,W.Hu,J.Leskovec,and S.Jegelka,”How powerful are graph neural networks”

안종훈 - 설명가능한 AI for AI 윤리

연사소개

저는 대학에 교수로 재직하다가 퇴직을 하고 인공지능콘텐츠LAB 이란 연구소를 만들고 현재 홈페이지 등 관련 작업을 진행하고 있습니다. 박사학위를 받은 후 2000년 초반 국내에 e러닝 이 처음 도입되던 시기에 향후 우리 교육에 IT기술 접목이 중요하겠다 싶어 교육공학 석사과 정에 등록, e러닝 교수학습 콘텐츠 제작 및 교수설계, 컨설팅 등 관련 공부를 하였습니다. 2011년, 디지털인문학 도입관련 논문발표를 하면서 자연스럽게 디지털기술로 그리고 인공지능 쪽으로 계속 연구를 하게 되었고, 현재는 인공지능산업컨설턴트(한국인공지능협회)로서 인공지 능 윤리와 안전 그리고 가버넌스 중심으로 강연 및 세미나를 진행하고 있습니다.

최근 인공지능 관련 논문발표

- 한국지능정보시스템학회 2018 춘계학술발표회(2018년 6월 1일): 인공지능스피커의 ‘윤리병합설계(Ethically Aligned Design)’ 전략

- 한국지능정보시스템학회 2019 춘계학술발표회(2019년 6월 1일): ADDIE모델 기반 데이터파이프라인 개발 및 데이터윤리 구현전략 - 설명가능하고 책임있는 AI 시스템 개발을 위해 -

그리고 한국인공지능협회 윤리분과 위원장으로서 다음달 7월 17일(수)-19일(금) 서울 코엑스 에서 열리는 대한민국인공대전 엑스포 기간 중 19일(금) 오후 1시부터 열리는 제 1회 대한민국 인공지능 윤리포럼을 준비하고 있습니다.

- 이메일: hamletahn@gmail.com

발표소개

2018년 제1회 DLCAT 발표자료들을 읽어보고는 우리나라 인공지능 딥러닝의 미래 전문가들 을 보게 되었습니다. 올해 제 2회 에서도 딥러닝 관련 좋은 발표 주제들이 많은데, 저는 그 중에 AI윤리관련 안전과 프라이버시 문제로 최근 부각되기 시작한 ‘설명가능한 AI(XAI)’를 인공지능 윤리와 연결시켜 발표합니다. 특히, 딥러닝에서 AI의 윤리적 의식과 도덕성 구현방법 에 관한 내용과 심을 가지고 있습니다. 개괄적인 주요 발표내용은 다음과 같습니다.

- What is Xai?, Why Xai? and Challenges

- Tay, Google, Uber Car Driving

- Social Effects and Business Effects

- Challenges

- Humanistic Background

- Human (Un)Consciousness and AI Consciousness

- Explainability vs. Interpretability

- Xai Case Studies

- DARPA and AI Fairness 360

- K-Xai Engine(V.1): L-TTEC Architecture

- AI Ethics and Governance System

- Machine Learning Algorithm and Data Ethics

- Toward AI Governance System

- What’s Next?

현재 진행하고 있는 개인적인 프로젝트로 조지아 공대 마크 리들과 브렌트 해리슨의 ‘이야기 를 이용해 인공 행위자에게 인간 가치를 가르치기’라는 논문에서 처럼 ‘키호테 (Quixote)’라는 이야기를 이용한 가치 학습 방법을 딥러닝으로 구현하는 기술개발을 해보려고 애를 쓰고 있습 니다.

발표자료

참고자료

- Alex Graves, Marc G. Bellemare, Jacob Menick, R”Lemi Munos, and Koray Kavukcuoglu, Automated Curriculum Learning for Neural Networks, Proceedings of the 34 th International Conference on Machine Learning, Sydney, Australia, PMLR 70. (2017)

- Carl Miller, The Death of Gods(2018)

- CIO Korea, “eAI의 블랙박스화’ 막겠다”c 오픈소스로 알고리즘 공개 선언한 IBM.

- CIO Korea, “g설명할 수 없는 AI라면 퇴출되어야 한다” IBM 지니 로메티

- DARPA, Explainable AI Update(2017). https://www.darpa.mil/attachments/XAIProgramUpdate.pdf.

- F. Doshi-Velez and Been Kim, Towards A Rigorous Science of Interpretable Machine Learning(2017)

- IBM, AI FAIRNESS 360: AN EXTENSIBLE TOOLKIT FOR DETECTING, UNDERSTANDING, AND MITIGATING UNWANTED ALGORITHMIC BIAS(2018)IDG TechReport,”g인공지능의 세대교체 “설명가능한 AI”, Explainable AI. Info World, Explainable AI: Peering inside the deep learning black box.

- Katharine Jarmul, Towards Interpretable Reliable Models, 19 October 2017. https://blog.kjamistan.com/towards-interpretable-reliable-models.

- Movie, Rashomon(1950). Pierre Fournier, Mohamed Chetouani, Pierre-Yves Oudeyer, and Olivier Sigaud, Accuracy-based Curriculum Learning in Deep Reinforcement Learning(2018)

- Y. Benkler, “From consumers to users: Shifting the deeper structure of regulations toward sustainable commons and user access”(2000)

이유한 - I’m Kaggler - Why need kaggle?

연사소개

현재 KAIST 생명화학공학과에서 박사과정 재학중이며, 전공은 분자 시뮬레이션입니다. 데이터 사이언스, AI를 어디서 배울지 고민하다가 캐글을 알게 된 후, 캐글이 취미가 된 대학원생입니다. 캐글에서 공부한 여러 ML, DL 스킬을 화공분야에 접목하고자 노력하고 있습니다. 저에게 큰 도움을 준 캐글을 다른 사람들과 함께 하고 싶어 발표자로 참여하게 되었습니다.

- 캐글 프로필: https://www.kaggle.com/youhanlee

발표소개

전세계 데이터를 사랑하는 사람들에게 데이터를 제공하고, 함께 즐길 수 있도록 해주는 캐글을 소개하려고 합니다. 작년 1st DL cat 에서 캐글 발표 이후 지난 1년간의 캐글 경험 및 후기를 들려드릴 것입니다. 제 발표를 들으시면, 왜 캐글이 ML, DL, DS 를 위한Project-based learnin(PBL) 을 할 수 있는 최적의 플랫폼인지 알게 되실 겁니다.

발표자료

참고자료

- 캐글 코리아 페이스북: https://www.facebook.com/groups/KaggleKoreaOpenGroup/

- 캐글 코리아 블로그: https://kaggle-kr.tistory.com/

13시

남기현 - (이론)딥러닝으로 오디오 만나보기

연사소개

한국외국어대학교 의료영상연구실에서 학부연구생으로 활동하고 있습니다. [NAVER TechTalk]에서 ‘딥러닝 Super Resolution, 어디까지 왔니?’를 발표한 적이 있으며, 현재는 음원 분리를 연구하고 있습니다.

- 홈페이지: https://devkihyun.github.io/

- 깃헙: https://github.com/DevKiHyun/

- 이메일: devkihyun@naver.com

발표소개

지금까지 해왔던 연구와는 완전히 달랐던 음원 분야를 연구하게 되어 이를 위해 공부했던 필수 지식들을 이번 시간에 여러분들과 공유하고자 합니다. 이 발표는 audio 분야는 처음인데 아무것도 아는 것이 없어 혼란스러운 분들과 딥러닝을 통한 audio 연구는 어떤 것이 있고 어떻게 하면 되는지 궁금하신 분들을 위한 발표입니다. 최대한 비전문가도 이해할 수 있도록 자료를 구성했으니 audio 분야에 도전하고자 하시는 분에게 도움이 되었으면 합니다.

발표자료

참고자료

TBD

김유민 - 딥러닝 모델 엑기스 추출(Knowlege Distillation)

연사소개

현재 경희대학교 컴퓨터공학과 머신러닝&비주얼컴퓨팅 연구실에서 석사과정 재학중이고, 딥러닝 모델 압축 알고리즘을 연구하고 있습니다.

- 이메일: rladbals0733@gmail.com

발표소개

여러 딥러닝 모델 압축 방법들 중 Knowledge Distillation분야의 연구 흐름을 관련 논문 리뷰를 통해 소개해드리려고 합니다.

발표자료

참고자료

- 논문

- Han et al. Learning both Weights and Connections for Efficient Neural Networks. In NIPS, 2015.

- Han et al. Deep Compression: Compressing Deep Neural Networks with Pruning, Trained Quantization and Huffman Coding. In ICLR, 2016.

- G. Howard et al. MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Applications. In arXiv, 2017.

- Chen et al. Big-Little Net: an Efficient Multi-Scale Feature Representation for visual and speech recognition. In ICLR, 2019.

- Szegedy et al. Going Deeper with Convolutions. In CVPR, 2015.

- Ba et al. Do Deep Nets Really Need to be Deep?. In NIPS, 2014.

- Hinton et al. Distilling the Knowledge in a Neural Network. In NIPS workshop, 2014.

- Romero et al. FitNets: Hints for Thin Deep Nets. In ICLR, 2015.

- Yim et al. A Gift from Knowledge Distillation: Fast Optimization, Network Minimization and Transfer Learning. In CVPR, 2017.

- Zagoruyko et al. Paying More Attention to Attention: Improving the Performance of Convolutional Neural Networks via Attention Transfer. In ICLR, 2017.

- Kim et al. Paraphrasing Complex Network: Network Compression via Factor Transfer. In NIPS, 2018.

- Furlanello et al. Born-Again Neural Networks. In ICML, 2018.

- Yu et al. Network Recasting: A Universal Method for Network Architecture Transformation. In AAAI, 2019.

- Park et al. Relational Knowledge Distillation. In CVPR, 2019.

홍원의 - (실습)한페이지 논문잡기:찾고+읽고+쓰고+정리하기

연사소개

카이스트 지식서비스공학 대학원을 석사 졸업하고 디플러스에서 데이터분석 강사로 활동하다 현재는 홍콩 과학기술대학교 (HKUST)에서 머신러닝을 전공하는 박사과정 학생입니다. 여름방학중 잠시 귀국해서 강의합니다.

- 홈페이지 : https://sites.google.com/view/woneuihong

- 깃헙 : https://github.com/laftworld

- 이메일 : wehong@cse.ust.hk

발표소개

연구란 무엇이고 어떤 절차로 수행하는지, 매일같이 쏟아지는 머신러닝 분야의 논문을 어떻게 읽고 정리하며 공부할지 함께 고민하는 시간을 마련했습니다. 국내 및 해외 연구실 생활에 대한 주관적인 경험도 공유합니다. 대학원 초년생이나 진학 예정자를 비롯해 연구에 대해 궁금한 분을 대상으로 발표합니다.

발표자료

오른쪽 그림 설명: 논문을 작성하는 절차와 방법에 대해서 발표합니다. 수영장 그림의 타일 하나하나가 논문입니다. 옛날에 깔린 타일은 교과서(textbook)가 되어 고등학생들이 배웁니다. 아직 타일이 깔리지 않은 바닥은 인류의 지식이 아직 닿지 않은 영역입니다. 그 경계에 대학원생이 타일깔기 연습을 하는 중이고 지도교수는 그것을 봐주고 있습니다. 논문작성에 대한 기본개념이 대체 머신러닝과 무슨 관련이 있는가 하실 수 있는데, 이것은 중요합니다. 머신러닝 분야만큼 하루가 멀다하고 논문이 수백편씩 쏟아지는 판이 없기 때문입니다. 논문 세상이 어떤 식으로 작동하는지를 이해하고, 우리는 이 위에서 어떻게 공부해야 할지를 나눠보는 시간을 갖습니다. 머신러닝은 많은 일반인들이 논문읽기를 하면서 공부하는 토픽인데 (일반적으로 재료과학 논문을 읽기모임하지는 않으니까요), 논문이 작성되고 출판되어 읽히는 과정에 대한 이해 없이 그저 논문읽기만 한다면 이 판의 빠른 흐름을 다 놓치게 되는 수가 있습니다. 이 발표는 (머신러닝)논문공부는 하고 싶은데 가이드가 없는 일반인 분들을 대상으로 논문판에 대한 큰그림을 그려보는 시간입니다.

참고자료

신경인 - (실습)파이토치로 갈아타기

연사소개

경희대학교 우주탐사학과에 2018년부터 재학 중인 석사 과정 학생입니다. 과를 보시면 아시겠지만 저는 딥러닝을 하게 될 거라고 생각한 사람은 아니었습니다. 솔직하게 말씀드리면, 저는 학부 졸업 때까지 컴퓨터 언어라고 하면 손사래부터 치는 사람이었죠. 그만큼 컴퓨터 언어에 자신도 없었고 잘하지도 못했습니다. 하지만 딥러닝으로 우주 분야 영상을 처리하는 연구를 맡았다가 세상을 바꾸는 딥러닝에 푹 빠졌죠. 딥러닝에 대한 열정이 생기니 기본적인 컴퓨터 언어 하나도 제대로 못했던 제가 Keras, TensorFlow를 거쳐 PyTorch까지 즐겁게 하게 되었습니다. 특히 PyTorch는 올해 3월부터 매주 토요일에 경희대에서 학부, 대학원생들을 대상으로 수업을 진행하고 있습니다. 현재는 내년에 컴퓨터공학 박사 과정 진학을 위해 동대학원 컴퓨터공학과 교수님의 공동지도를 받고 있습니다.

현재 진행하고 있는 연구는 두 개로 하나는 서로 다른 두 필터로 찍은 태양 영상 간의 변환(우주탐사학과 관련)이고 다른 하나는 분류 과업을 위한 attention module 개발(컴퓨터공학 관련)입니다. 비록 제 발표에서는 다루지 않겠지만 관심 있으신 분들과 소통할 수 있기를 바랍니다.

- 이메일: gishin@khu.ac.kr

발표소개

딥러닝으로 빠른 시간에 성과를 내려면 어느 프레임워크를 이용해야 할까요? 딥러닝을 하기 위한 도구를 제공하는 프레임워크는 정말 다양합니다 - Caffe(2), CNTK, Keras, PyTorch, TensorFlow, Theano 등. 각자가 더 많이 쓰이는 딥러닝 분야도 다르고 장단점도 다릅니다. 그럼에도 불구하고 저는 주변 사람들에게 얘기합니다. 적어도 처음 시작했던 저에게 가장 쉽고 직관적으로 다가왔던 프레임워크는 PyTorch였다고 말이죠. Keras를 이용해 코드를 짜다보면 TensorFlow에 대한 이해가 필요한 경우가 종종 있었습니다. 그렇다고 TensorFlow를 하려니 배워야 할 게 너무 많았죠. 그렇다면 PyTorch는? Python 클래스에 대한 기본적인 이해면 충분합니다. 그렇기 때문에 직관적이고 빠르게 적응할 수 있다는 큰 장점이 있습니다. 얼른 자신의 분야에 딥러닝을 적용하고 성과를 내고 싶으신가요? PyTorch로 오세요. 이번 발표에서는 오시는 분들의 선호에 따라 간단한 분류 모델 혹은 GAN(Generative Adversarial Networks) PyTorch 코드를 짜면서 실습을 진행할 예정입니다. 제 발표를 들으면 유익하실 분들과 그렇지 않을 분들을 아래에 정리해놓았습니다.

- 발표가 유익하실 분들.

- 빨리 딥러닝을 자신의 분야에 적용하고 싶으신 분들

- 딥러닝을 시작한지 오래 되지 않아서 (혹은 아직 시작하지 않아서) 어떤 프레임워크를 쓰면 좋을지 모르겠는 분들

- 기존에 쓰시던 프레임워크가 복잡하다고 느껴져서 친숙하지 않은 분들

- PyTorch에 사용법에 대해 알고 싶으신 분들

- 발표가 유익하지 않으실 분들.

- 이미 애용하는 프레임워크가 있으신 분들

- 전문적인 딥러닝 개념을 듣고 싶으신 분들

발표자료

참고자료

- 파이토치 튜토리얼 사이트: https://tutorials.pytorch.kr/

전미정 - 실습)MS Azure ML Service와 함께하는 AutoML 사용하기

연사소개

전미정

안녕하세요, Keras Korea 운영진 미정입니다. 작년 1st 함께하는 딥러닝 컨퍼런스에서 모바일 딥러닝 주제로 즐겁게 발표하고, 많은 분과 네트워킹했던 좋은 기억을 가득 안고 2nd DLCAT에 돌아왔습니다 🕊

저는 냐옹이, 여행 그리고 공부를 좋아하는 평범한 사람이에요. 만들고 싶은 iOS 애플리케이션이 있어 개발을

시작하게 되었고, 모바일에 딥러닝을 심어보고 싶어 머신러닝을 공부하게되었죠. 다른 연사분들처럼 멋진 전문 지식이나 경험은 별로 없지만 제가 공부하고 경험한 내용을 많은 사람들과 공유하는걸 즐긴답니다. 2nd DLCAT에서도 잘 부탁드립니다 🤗

📮 ninevincentg@gmail.com

🐙 https://github.com/MijeongJeon

👍 https://www.facebook.com/Ninevincent

그리고, 원활한 진행을 위해 실습을 도와주실 멋쟁이, 재원님을 소개합니다 👏🏻

이재원

딥러닝을 사랑하는 대학원생입니다.

몇 해 전 컴퓨터비전과 딥러닝을 처음 접했고 아직도 그 매력에서 헤어나오지 못하고 있습니다.

많은 분들과 소통했으면 좋겠습니다 :D

📮 insurgent92@gmail.com

🐙 https://github.com/visionNoob

발표소개

여러분은 머신러닝 모델을 어디서 학습하고 관리하시나요?

GPU가 없어 느린 학습 속도에 좌절😫 해봤거나, 어떤 모델을 생성해야 좋을지 고민한 적이 있다면, 2nd DLCAT에서 Cloud ML/AutoML를 만나보세요!

MS Azure ML Service와 함께하는 AutoML 사용하기 세션은 Microsoft Azure ML Service에서 최적의 머신러닝 모델을 찾으며 Cloud ML Service와 AutoML에 대한 경험을 쌓아보는 시간입니다.

한번도 Clould 서비스를 사용해보지 않았거나, Azure 유료계정이 없어도 걱정하지 말고 노트북과 열정만 가지고 오세요. Microsoft에서 지원하는 Sponsor Pass로 마음껏 학습시켜보아요 ☄️

- Cloud ML service/Azure AutoML을 사용해 보고 싶은 분 환영입니다 🤗

- 머신러닝 모델을 직접 학습시켜본 경험이 있다면 더욱 좋습니다.

- 세션 시작 전, https://signup.live.com/에서 Microsoft 무료 계정을 생성해주세요(이미 계정이 있다면 편한 마음으로 오시면 됩니다).

발표자료

참고자료

서정훈 - 빽 투 더 Representation Learning: Visual Self-supervision을 중심으로

연사소개

위성항공 전문기업 쎄트렉아이에서 머신러닝 연구원으로 재직 중입니다. Profile

발표소개

00년 후반에 제안된 RBM/DBN의 중요성이 줄어든 이후 사전학습(Pre-training)을 위한 표현 학습(Representation Learning)은 꽤 오랜 시간 동안 사장된 개념이었습니다. 하지만 최근 페이스북, OpenAI, 딥마인드 등의 연구 그룹을 중심으로 표현학습을 다루는 연구가 다시금 쏟아져나오고 있습니다. Visual Self-supervision을 중심으로, 본 발표에서는 다음과 같은 내용을 다루고자 합니다.

- 왜 표현 학습이 다시 연구의 화두로 대두되었지

- 다시 부활한 표현 학습, 연구자들은 어떻게 접근하고 있는지

- 중요 표현 학습 연구들에 관한 초스피드 간단 리뷰

주요 키워드: Visual Representation Learning, Self-supervised Learning, Data-efficiency

발표자료

참고자료

TBA

14시

황준원 - (실전)딥러닝으로 오디오 만나보기

연사소개

성균관대학교 소프트웨어학과에 재학중인 학부생이고, 다양한 딥러닝 분야를 골고루 배우며 연구부터 개발까지 두루 갖추고자 합니다. 현재 케라스 코리아 운영진 및 케라스 코리아 오픈채팅 방장을 맡고 있으며, 페이스북 그룹과 오픈 채팅방에서 다른 연구자 및 개발자 분들과 교류하고 있습니다. 지난 KCD2019에서는 케라스 코리아 세션에서 “이상한 폰트 나라로 뛰어들기” 를 발표했습니다.

- 홈페이지: https://nuxlear.github.io/

- 깃헙: https://github.com/nuxlear

- 페이스북: https://www.facebook.com/nuxlearHwang

발표소개

최근 프로젝트를 통해 음성 데이터를 처음 다뤄보면서 음성 데이터를 전처리하고 모델 학습에 사용하는 여러 방법을 접해보았습니다. 음성은 데이터 차원의 수가 이미지보다 적지만 그 특성이 꽤 달라 사전 지식과 테크닉들이 필요했습니다. 이에 처음 음성 데이터를 다루면서 겪을 만한 어려움과 새로이 배운 노하우들을 공유하기 위해 발표를 준비했습니다. 바로 전 시간에 준비되어 있는 남기현 님의 이론편에 이어, 실제로 audio를 불러오고 다양한 feature를 추출하는 전처리와 augmentation, 그리고 연산 속도를 높이기 위한 GPU 연산 사용법을 간단한 예시 코드와 함께 소개해 드리려 합니다. audio 데이터를 활용한 딥러닝 연구를 처음 시작하시는 분들께 도움이 되었으면 합니다.

발표자료

참고자료

TBD

김영하 - AutomatedML 동향

연사소개

TBD

발표소개

TBD

발표자료

참고자료

TBD

송규예 - Deeplema, 딥러닝 서비스상용화의 딜레마

연사소개

ML GDE(Machine Learning Google Developer Expert)입니다. 기계공학을 전공했지만 졸업 후엔 코드를 읽고 쓰는 일을 했습니다. 텐서플로 문서 번역에 기여하면서 소프트웨어와 과학의 경계를 흥미롭게 탐험하고 있습니다. “머신 러닝 교과서 with 파이썬, 사이킷런, 텐서플로”, “케라스 창시자에게 배우는 딥러닝”(이상 길벗), “(개정판)파이썬 라이브러리를 활용한 머신러닝”, “핸즈온 머신러닝”, “텐서플로 첫걸음”(이상 한빛미디어)을 번역했습니다.

발표소개

비즈니스 관점에서의 딥러닝에 대한 톡입니다. 실제 비즈니스 상에서 기술에 대한 오해나 상용화에 대해 접근방법이 아쉬운적이 많았고 여기에 대한 의견을 나누고자 합니다.

발표자료

참고자료

TBD

15시

민규식 - 강화학습 환경 제작, Unity ML-agents와 함께하세요

연사소개

현재 한양대학교 미래자동차공학과 기계감지 및 제어연구실 (MML Lab.)에서 석박사 통합과정 중에 있습니다. 자율주행차량 및 운전자 보조 시스템에 대한 연구를 수행하고 있으며 딥러닝, 강화학습, 유니티에 대해 공부하고 있습니다. 페이스북 페이지 Reinforcement Learning Korea의 운영진 중 한명으로 활동하고 있으며 유니티 코리아에서 공인한 유니티 전문가 그룹인 유니티 마스터즈 3기에 선정되었습니다.

- 깃헙: https://github.com/Kyushik

- 이메일: kyushikmin@gmail.com

- 구글 scholar: https://scholar.google.co.kr/citations?user=dz8VK3IAAAAJ&hl=ko

발표소개

강화학습에서는 강화학습 알고리즘 자체도 중요하지만 강화학습 알고리즘을 테스트 하기 위한 환경을 구성하는 것도 매우 중요합니다. 지난 2017년 9월에 공개된 Unity ML-agents는 강화학습 알고리즘을 테스트 할 게임 및 시뮬레이션 환경을 비교적 간단하게 구현할 수 있도록 도와주는 고마운 툴입니다. 본 발표에서는 Unity ML-agents에 대한 소개 및 사용법에 대한 설명을 진행할 예정입니다. 또한 Unity ML-agents를 통해 구현한 강화학습 환경들의 예시를 소개하려 합니다.

발표자료

참고자료

- Unity ML-agents 공식 깃헙: https://github.com/Unity-Technologies/ml-agents

- RLKorea Unity ML-agents 튜토리얼 팀 깃헙: https://github.com/reinforcement-learning-kr/Unity_ML_Agents

김태진 - 구글 코랩 TPU 알아보기

연사소개

부산대 정보컴퓨터공학부 졸업하고 캐글이 너무 재미있어서 취직도 마다하고 캐글에 뛰어들고 있는 직업이 백수고 업무가 캐글인 김태진입니다. 저는 학과 공부의 완성은 학교 밖에 있다고 생각해서 학부때는 공모전을 정말 많이 나갔었고 창업동아리 활동도 했었습니다. 정말 공부 외적인 것만 좋아해서 문제입니다만, 다양한 경험은 항상 저를 성장하게 만드는거 같아요! 현재는 캐글코리아 그룹의 운영진을 맡고 있습니다. 관심분야는 캐글, NLP, 딥러닝 등등 입니다.

발표소개

데이터 사이언스, 머신러닝 그 중에서도 딥러닝을 위해서는 GPU가 필수입니다. 하지만 GPU가 하늘에서 굴러 떨어지는 것도 아니고, 물론, 캐글 커널과 구글 코랩에 좋은 리소스를 제공하고 있지만, 성능도 그렇게 좋은거 같지는 않은데 세션은 자꾸 날아가는 바람에 기껏 만들었던 모델도 날려 먹었던 경험이 다들 한번쯤은 있으실 거에요. 그런데, 구글 코랩에 정말 굉장하고 엄청난 딥러닝 컴퓨터가 있다는 것, 알고 계신가요? 그것도 무료로 쓸 수 있는데, 성능은 V100과 맞먹는다? Google Colab TPU의 사용 방법과 알아 두면 쓸데 있는 여러 팁에 대해 같이 이야기 해보아요.

발표자료

참고자료

TBD

김보섭 - Structuring your first NLP project

연사소개

현재 LG전자 인공지능연구소에서 Researcher로 일하고 있습니다. 모두의 연구소에서 NLP 관련 스터디 모임(NLP Bootcamp)에서 faciliator로 활동하고 있으며, 모두를 위한 딥러닝 시즌 2 (TensorFlow)에 Contributor로 참여하였습니다. 현재는 Bayesian NN, Novelty Detection기반으로 Uncertainty를 NLP의 여러분야에 적용하는 연구를 하고 있습니다.

- 홈페이지: https://aisolab.github.io/

- 깃헙: https://github.com/aisolab

- 이메일: bsk0130@gmail.com

발표소개

NLP 논문을 구현할 때, 항상 수반하는 전처리(Vocabulary, Tokenizer, Embedding 등)들을 반영하는 project template (project structure)을 구성하고, 구현 시 modulization을 어떻게 효율적으로 해야하는 가에 관하여 소개합니다. 소개한 project template을 토대로 PyTorch로 구현한 “Convolutional Neural Networks for Sentence Classification”을 네이버 영화평점 데이터에 적용해봅니다. (논문의 상세한 내용에 대해서는 소개하지 않습니다. 발표자료를 참고해주세요)

- 발표가 유익하실 분들

- 논문 구현을 project template 토대로 구현한 경험이 없으신 분들

- 논문 구현에 관심있으신 분들

- 자기자신만의 project template 구성에 관심있으신 분들

- NLP 논문 구현에 관심있으신 분들

- 발표가 유익하지 않으신 분들

- 이미 사용하고 계신 project template이 있으신 분들

- 전문적인 딥러닝 개념을 듣고 싶으신 분들

발표자료

참고자료

- 논문: https://arxiv.org/abs/1408.5882

- 깃헙: https://github.com/aisolab/nlp_implementation/tree/master/Convolutional_Neural_Networks_for_Sentence_Classification

이진원 - Efficient CNN 톺아보기

연사소개

현재 삼성전자에서 Staff Engineer로 일하고 있습니다. Deep Learning Hardware Accelerator와 모델 경량화를 연구하였습니다. PR12 논문 읽기 모임을 3년째 참여하고 있고, Facebook TensroFlow Korea group에서 운영진으로도 활동하고 있습니다.

- 깃헙 : https://github.com/jwlee-ml

- 이메일: jwlee.ml25@gmail.com

발표소개

ImageNet에서 ResNet이 human performance를 뛰어넘은 이후 efficiency를 중요시하는 CNN들이 계속 연구되어 왔는데 최근까지의 흐름을 쭉 정리해보고자 합니다.

발표자료

참고자료

- 논문

- Going Deeper with Convolutions

- Very Deep Convolutional Networks for Large-Scale Image Recognition

- SqueezeNet: AlexNet-level accuracy with 50x fewer parameters and <0.5MB model size

- SqueezeNext: Hardware-Aware Neural Network Design

- MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Applications

- MobileNetV2: Inverted Residuals and Linear Bottlenecks

- Searching for MobileNetV3

- ShuffleNet: An Extremely Efficient Convolutional Neural Network for Mobile Devices

- ShuffleNet V2: Practical Guidelines for Efficient CNN Architecture Design

- Shift: A Zero FLOP, Zero Parameter Alternative to Spatial Convolutions

- CondenseNet: An Efficient DenseNet using Learned Group Convolutions

- All You Need is a Few Shifts: Designing Efficient Convolutional Neural Networks for Image Classification

- Fully Learnable Group Convolution for Acceleration of Deep Neural Networks

김경환,박진우 - (실습)강화학습 해부학 교실: Rainbow, 이론부터 구현까지

연사소개

현재 Medipixel에서 research engineer로 재직중이며, 강화학습을 통해 심혈관 중재시술(PCI) 일부 과정을 자동화하는 연구를 진행하고 있습니다. 심혈관 중재시술의 핵심은 혈관 내에서 병변부위까지 무사히 도달할 수 있도록 wire를 제어하는 기술입니다. 특히 wire 제어는 굉장히 풀기 어려운 non-linear system으로 악명이 높은데, 저희는 그 동안의 성과물을 통해 강화학습에 의한 wire 제어의 가능성을 조금씩 세상에 보여주고 있습니다.

- 블로그: https://mrsyee.github.io / https://curt-park.github.io/

- 깃헙: https://github.com/MrSyee / https://github.com/Curt-Park

- 이메일: khsyee@gmail.com / www.jwpark.co.kr@gmail.com

발표소개

Atari 환경에서 아주 좋은 성능을 보여주는 강화학습 알고리즘인 Rainbow를 공부해 봅니다. Rainbow를 구성하는 DQN, PER, Double-Q, Dueling Network, NoisyNet, C51, N-Step TD의 이론적 배경을 함께 살펴보고, Rainbow의 파이토치 구현을 line-by-line으로 뜯어봅시다. (노하우 대방출)

발표자료

참고자료

- 논문

- V. Mnih et al., “Human-level control through deep reinforcement learning.” Nature, 518 (7540):529–533, 2015.

- T. Schaul et al., “Prioritized Experience Replay.” arXiv preprint arXiv:1511.05952, 2015.

- van Hasselt et al., “Deep Reinforcement Learning with Double Q-learning.” arXiv preprint arXiv:1509.06461, 2015.

- Z. Wang et al., “Dueling Network Architectures for Deep Reinforcement Learning.” arXiv preprint arXiv:1511.06581, 2015.

- M. G. Bellemare et al., “A Distributional Perspective on Reinforcement Learning.” arXiv preprint arXiv:1707.06887, 2017.

- M. Fortunato et al., “Noisy Networks for Exploration.” arXiv preprint arXiv:1706.10295, 2017.

- M. Hessel et al., “Rainbow: Combining Improvements in Deep Reinforcement Learning.” arXiv preprint arXiv:1710.02298, 2017.

- 깃헙

- https://github.com/medipixel/rl_algorithms

- https://github.com/Kaixhin/Rainbow

- https://github.com/higgsfield/RL-Adventure

- https://github.com/openai/spinningup

16시

김태영 - 이제 하이퍼파라미터 튜닝은 케라스 튜너에게 맡기세요

연사소개

현재 (주)인스페이스에서는 기술이사로서 “태양에서 세포까지 딥러닝”, “게임에서 우주까지 강화학습”의 모토로 여러분야 인공지능을 적용하고자 활발히 연구개발하고 있습니다. 경희대학교 우주탐사학과 박사과정 중에 있으며 대딥사, 케라스 코리아, 캐글 코리아 등 오픈 커뮤니티 운영진으로써 즐거운 인공지능 생태계 조성에 조금이라도 보탬이 되고자 합니다.

발표소개

딥러닝에 입문하여 어느정도 모델을 구성할 수 있다면, 그 다음 고민은 어떻게 이 모델을 튜닝해서 성능을 높일까입니다. 이 과정을 하이퍼파라미터 튜닝이라고 하는데, 모델을 구성하는 여러 요소 중에 최적의 요소 값을 찾아내는 과정을 말합니다. 케라스 모델을 쉽게 튜닝하는 프레임워크를 구글에서 개발했다고 하니 살펴보도록 하겠습니다.

발표자료

참고자료

김형섭 - GAN 동향

연사소개

TBD

발표소개

TBD

발표자료

TBD

참고자료

TBD

차금강 - 설명가능한 강화학습(Explainable Reinforcement Learning)

연사소개

안녕하세요 현재 너드팩토리에서 자연어처리를 이용한 여러가지 문제를 풀고 있는 강입니다. 챗봇 시스템, 언어처리를 이용한 추천시스템 등을 연구/개발하고 있으며 진정한 의미의 인공지능으로써 강화학습을 연구하고 있습니다.

- 깃헙: http://github.com/chagmgang

- cv: https://github.com/chagmgang/cv

- 이메일: chagmgang@gmail.com

발표소개

현재 DeepMind, OpenAI가 선두가 되어 많은 강화학습 문제들이 해결되고 있습니다. 하지만 내부 모델이 왜 특정 상태에서 해당 행동을 하는지는 인공신경망 특성상 알기 어렵습니다. DeepMind에서는 이러한 문제를 자연어 문제에서 흔히 사용하는 self-attention 모델을 이용하여 설명하는 인공신경망을 발표하였습니다. 이는 추후 설명가능한 진정한 의미의 AI가 될 수 있는 가능성을 내포하고 있습니다. 이에 대해서 구현하고 설명하는 내용을 발표할 것 입니다.

발표자료

참고자료

- Attention Is All You Need

- Proximal Policy Optimization Algorithms

- A simple neural network module for relational reasoning

- Relational Deep Reinforcement Learning

17시

옥찬호 - 카드게임 강화학습 환경 개발기 - 하스스톤

연사소개

현재 넥슨 코리아에서 게임 클라이언트 개발을 담당하고 있습니다. C++와 게임 개발, 컴퓨터 그래픽스, 강화학습, 오픈 소스에 관심이 많습니다. 페이스북 C++ Korea 그룹을 운영하며 스터디 활동과 함께 다양한 책을 번역/집필 중이며, 남는 시간엔 학생들과 함께 다양한 오픈 소스 프로젝트를 진행하며 보다 나은 미래를 만들기 위해 노력하고 있습니다. 옮긴 책으로는 『게임샐러드로 코드 한 줄 없이 게임 만들기』 (에이콘출판사, 2013), 『유니티 Shader와 Effect 제작』 (에이콘출판사, 2014), 『2D 게임 프로그래밍』 (에이콘출판사, 2014), 『러스트 핵심 노트』 (한빛미디어, 2017), 『모던 C++ 입문』 (길벗, 2017), 『C++ 최적화』 (한빛미디어, 2019)이 있습니다.

- 블로그: https://utilforever.github.io

- Github: https://github.com/utilforever

- 이메일: utilForever@gmail.com

발표소개

2016년, 딥마인드에서 개발한 인공지능 바둑 프로그램인 ‘알파고’는 전세계에 커다란 충격을 안겨주었습니다. 최근에는 스타크래프트2 AI ‘알파스타’를 통해 프로게이머에게 10 대 1로 압승해 또 한 번 세계를 놀라게 했습니다. 이를 통해 강화학습에 관심을 갖게 되어 어떤 게임에 적용해볼까 고민하다가 평소 즐기던 ‘하스스톤’이라는 게임에 관심을 갖게 되어 2017년 말부터 하스스톤 강화학습을 위한 API를 만들기 시작했습니다. 이 세션에서는 하스스톤이라는 게임을 간단하게 설명하고 기존 게임과 어떤 부분이 다른지 살펴봅니다. 그리고 현재까지 하스스톤 강화학습과 관련해 진행되었던 연구들을 살펴보고 어떤 한계점을 갖고 있는지 설명합니다. 다음으로 약 1년 반 동안 하스스톤을 만들면서 어떤 기술들을 적용했는지, 그리고 개발하는 과정에서 어떤 어려움을 겪었고 해결했는지 이야기합니다. 마지막으로 강화학습을 위한 환경을 구축하기 위해 작업했던 내용들을 설명하고 완성된 학습 환경을 통해 AI를 어떻게 학습할 수 있는지 살펴봅니다. 이 발표를 통해 평소 하스스톤과 같은 카드 게임 개발이나 게임에 강화학습을 적용하기 위한 환경을 구축하는데 관심을 갖고 있던 프로그래머들에게 조금이나마 도움이 되었으면 합니다.

발표자료

참고자료

TBD

대전 AI 거버넌스

연사소개

안창욱 - 광주과학기술원(GIST) - e-mail: cwan@gist.ac.kr 이준 - 산업연구원(KIET) - e-mail: jlee@kiet.re.kr 이순석 - 한국전자통신연구원(ETRI) - e-mail: sslee@etri.re.kr 유용균 - 원자력연구원(KAERI) - e-mail: ygyu@kaeri.re.kr 이홍석 - 한국과학기술정보연구원(KISTI) - e-mail: hsyi@kisti.re.kr 안효정 - 한국항공우주연구원(KARI) - e-mail: hjahn@kari.re.kr

발표소개

대전 산업 AI 생태계 활성화 및 거버넌스 구성 방안

발표자료

참고자료

TBD

질답과 이모저모

신청 시에 올려주셨던 질문에 답변드립니다.

- Q: 대전역이나 터미널에서 셔틀버스 운행이나, 교통편 안내 부탁드립니다.

- 사시는 지역이 터미널과 가깝다면 터미널 이용을 추천드립니다. 유성고속버스터미널, 유성시외버스터미널, 대전청사고속버스터미널, 대전청사시외버스터미널이 가깝습니다. 가장 가까운 터미널은 도룡고속시외버스터미널이 있는데, 해당 터미널에 정차하는 지는 사전에 확인 필요합니다. 터미널에서 오실 때는 마을버스/일반버스나 택시를 타고 오시면 됩니다.

- 행사 지역이 대전역이랑 꽤 거리가 되기 때문에, 역에서 오실 때는 택시가 가장 편합니다. 시간적인 여유가 있다면, 대전역 > 지하철 > 대전정부청사역 하차 > 버스 탑승으로 와야하는데, 거의 한시간은 잡아야합니다.

- Q: 홍보가 제대로 되지 않아 아쉽습니다.

- 오픈 커뮤니티 위주로 진행되다보니 대대적인 홍보가 되지는 않는 것 같습니다.

- 하지만 좋은 행사라고 각 기관이나 회사 사내 사이트에 무단으로 홍보하시는 분들이 간혹 계시는 데, 너무나 감사합니다. 이런 분들이 많이 계셨으면 좋겠습니다.

- Q: 왜 서울에서 하면 참여율이 높은 것 같은데 왜 대전에서 하는지요?

- 서울에서 하면 더 많은 분들이 오실 수 있겠지만, 서울과 거리가 먼 지방에서는 오시기가 쉽지 않기 때문에 “모두가 함께하는” 딥러닝 컨퍼런스가 되기 위해 대한민국 중앙인 대전으로 선정하였습니다.

- Q: 중간 중간에 트랙을 옮길 수 있나요?

- 물론입니다. 세션 당 한시간인데, 40분발표, 5분 질의응답, 나머지 15분을 더 남아서 토의를 하거나 이동을 위한 시간입니다.

- UST과 ETRI 건물을 도보로 10분이면 충분히 이동할 수 있습니다. 다만 날씨가 더워서 조금 걱정입니다.

- Q: 실습 세션은 노트북을 챙겨야하나요? 콘센트가 충분한지요?

- 실습 세션을 들으시는 분은 노트북을 지참해주세요~

- 콘센트가 충분하지 않습니다. 충분히 전원을 충전을 해오세요~ 행사장에서 충전을 할 수 있도록 별도 장소 혹은 안내를 할 예정입니다.

- Q: 오후 늦게 가도 (중간에 참석해도) 되는지요?

- 물론입니다! 편하게 일이 있으시다면, 먼저 가시거나 나중에 오셔도 됩니다.

- 다만 오시기만 한다면, 함께한 시간에 대한 뿌듯함과 함께하지 못한 시간에 대한 아쉬움을 가지고 가실껍니다~

- Q: 참가비도 없는데 굳이 신청을 한 후 참석해야 하나요?

- 원활한 행사를 위해서 가장 신경써야 할 것이 바로 참가 인원이더라구요. 참가비를 받으면 사전이 인원을 알수 있어서 준비도 그에 맞게 하면 되지만, 참가비를 받지 않으면 현장에서 신청하시는 분들도 많고, 노쇼도 있을 수 있습니다(다행이 저희 행사에는 노쇼가 잘 없습니다). 그래서 많은 부분을 예측을 하면서 준비해야 하는데, 그렇다하더라도 참가 신청하신 분들의 수가 기준이 되기에 중요합니다.

- Q: 동영상 녹화나 라이브 방송을 하실 계획인가요?

- 본 모임에서 지식교류가 많이 일어날 것이지만 그보다 더 중요하게 생각한 건 “함께하는 즐거움”입니다. 연사분들도 참석자분들이랑 소통하는 즐거움에 신명나게 발표하고 참석자분들도 격식없이 자유롭게 평소 궁금하던 것을 물어보면서 정말 딥러닝을 공부하면서 “즐거운 순간”이다라는 것을 담고 가시길 희망합니다. 그걸 방해하는 요소 중 하나 바로 “동영상 촬영”이라 생각하기에 녹화나 라이브 방송은 없을 예정입니다. 그 순간에 집중해서 맘 것 즐겨주십시요~

- Q: 예전엔 사람이 많아서 서서 들었는 데, 좌석이 충분했으면 좋겠습니다.

- 아쉽게도 이 부분은 어쩔 수 없을 것 같습니다. 다양한 분야에서 각기 다른 관심으로 오시기에 어디에 몰릴 지 예측하기도 힘들고, 연사분들의 즐거움을 나눌 수 있도록 연사분들에게 세션을 선택하시겠금 하였기에 불가피한 상황이 발생할 수 있습니다. 이점 양해부탁드립니다!

- Q: 잘 모르는 주제가 많아서 기대됩니다.

- 저도 그렇습니다. 강화학습에선 “탐험”과 “탐색”이란 개념이 나오는데, 이번 기회에서 새로운 분야, 새로운 내용에 “탐험”을 할 수 잇는 좋은 기회라고 생각합니다. 잘 모르는 내용일수록 한 번 참석해보는 것은 어떨까요?

- Q: 실습 시에 준비해야될 것이 무엇인가요?

- 현재 연사별로 별도 페이지를 작성하고 있습니다. 거기에 안내사항을 상세히 기재할 예정입니다. 또한 질문이 있으시면 해당 페이지에 질문을 올려주시면 감사하겠습니다.

- Q: 커피 한 잔은 어느분께 언제 어떻게 사드리면 되나요?

- 질문 의도 파악이 되진 않지만, 지금 연사분들은 인터넷에서도 많이 활동하시는 분들이기에 평소 도움을 받으신 분들도 계실 겁니다. 그 연사분께 발표 전에 시원한 아메리카노 똭~ 올려놓으면 어떨까요?

- Q: 독일에서 한국에 귀국하자마자 다음날 대전으로 달려갑니다.

- 여독으로 힘드실텐데도 불구하고 그 열정에 감사함을 보내드립니다. 참석해주셔서 감사드립니다. 무사 귀국 하십시요!

- Q: 결석 및 휴가를 내서라도 꼭 가겠습니다.

- 좋은 행사에 마음 편하게 오실 수 있도록 최대한 노력하겠습니다. 그 노력에는 참가확인증 발급이라던지 담당선생님, 교수님, 상사 등에 주최측에서 초청 메일을 보낸다던지 입니다. “모두가 함께하는 딥러닝 컨퍼런스”가 되었으면 합니다.

- Q: 점심은 어디서 어떻게 먹나요?

- 차가 없는 상태에서 이동이 불편하기 때문에 현재 인근 식당, 푸드트럭, 배달 등 여러가지 가능성을 열어놓고 알아보고 있습니다. 다음 공지때 안내드리겠습니다.

같이 보기

책 소개

[추천사]

- 하용호님, 카카오 데이터사이언티스트 - 뜬구름같은 딥러닝 이론을 블록이라는 손에 잡히는 실체로 만져가며 알 수 있게 하고, 구현의 어려움은 케라스라는 시를 읽듯이 읽어내려 갈 수 있는 라이브러리로 풀어준다.

- 이부일님, (주)인사아트마이닝 대표 - 여행에서도 좋은 가이드가 있으면 여행지에 대한 깊은 이해로 여행이 풍성해지듯이 이 책은 딥러닝이라는 분야를 여행할 사람들에 가장 훌륭한 가이드가 되리라고 자부할 수 있다. 이 책을 통하여 딥러닝에 대해 보지 못했던 것들이 보이고, 듣지 못했던 것들이 들리고, 말하지 못했던 것들이 말해지는 경험을 하게 될 것이다.

- 이활석님, 네이버 클로바팀 - 레고 블럭에 비유하여 누구나 이해할 수 있게 쉽게 설명해 놓은 이 책은 딥러닝의 입문 도서로서 제 역할을 다 하리라 믿습니다.

- 김진중님, 야놀자 Head of STL - 복잡했던 머릿속이 맑고 깨끗해지는 효과가 있습니다.

- 이태영님, 신한은행 디지털 전략부 AI LAB - 기존의 텐서플로우를 활용했던 분들에게 바라볼 수 있는 관점의 전환점을 줄 수 있는 Mild Stone과 같은 책이다.

- 전태균님, 쎄트렉아이 - 케라스의 특징인 단순함, 확장성, 재사용성을 눈으로 쉽게 보여주기 위해 친절하게 정리된 내용이라 생각합니다.

- 유재준님, 카이스트 - 바로 적용해보고 싶지만 어디부터 시작할지 모를 때 최선의 선택입니다.